এআর ডেভেলপমেন্টের জন্য ভার্চুয়াল হেড প্লেসমেন্টে চ্যালেঞ্জ

একটি অগমেন্টেড রিয়েলিটি (AR) প্রকল্পে কাজ করা উত্তেজনাপূর্ণ এবং চ্যালেঞ্জিং উভয়ই হতে পারে। ইউনিটির সাথে একটি অ্যান্ড্রয়েড অ্যাপ্লিকেশান ডেভেলপ করার সময়, আমি বাস্তব-বিশ্বের মুখের উপর ভার্চুয়াল মাথা রেখে ডিজিটাল এবং বাস্তব জগতকে নির্বিঘ্নে মিশ্রিত করার লক্ষ্য নিয়েছিলাম। এই বৈশিষ্ট্যটি একটি নিমজ্জিত অভিজ্ঞতা তৈরি করতে নির্ভুলতার উপর অনেক বেশি নির্ভর করে। 🕶️

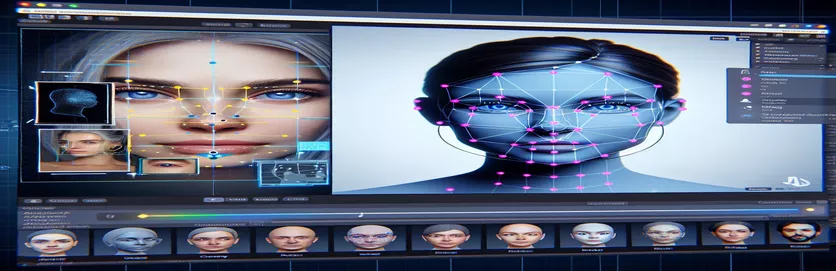

এটি অর্জন করতে, আমি চোখ, নাক এবং মুখের মতো মুখের ল্যান্ডমার্ক সনাক্ত করতে Google এর মিডিয়াপাইপ ব্যবহার করেছি। ভার্চুয়াল হেড তারপর তৈরি করা হয়েছিল এবং এই মূল পয়েন্টগুলির উপর ভিত্তি করে স্থাপন করা হয়েছিল। আধুনিক সরঞ্জামগুলি কীভাবে AR সম্ভাবনাগুলিকে রূপান্তরিত করতে পারে তা দেখতে আকর্ষণীয় ছিল, তবে ভ্রমণটি নিখুঁত থেকে অনেক দূরে ছিল।

প্রত্যাশিতভাবে ভার্চুয়াল হেড প্রকৃত মুখের সাথে সারিবদ্ধ না হলে সমস্যাটি দেখা দেয়। কোণ বা ডিভাইস যাই হোক না কেন, প্লেসমেন্ট সবসময় একটু "বন্ধ" ছিল, যা একটি অপ্রাকৃত প্রভাবের দিকে নিয়ে যায়। এটা যেন ভার্চুয়াল উপস্থাপনা বাস্তবতা থেকে সংযোগ বিচ্ছিন্ন ছিল. এটি সমস্যা সমাধানের পরীক্ষার একটি সিরিজের জন্ম দিয়েছে।

Unity-এর ক্যামেরা সেটিংস টুইক করা থেকে MediaPipe-এর অ্যালগরিদম নিয়ে পরীক্ষা-নিরীক্ষা পর্যন্ত, প্রতিটি প্রচেষ্টাই ক্রমবর্ধমান উন্নতি এনেছে কিন্তু কোনো সুনির্দিষ্ট সমাধান নেই। এই নিবন্ধটি সমস্যার মূল বিষয়, শিখে নেওয়া পাঠ এবং একই ধরনের চ্যালেঞ্জের সম্মুখীন ডেভেলপারদের সম্ভাব্য সমাধান সম্পর্কে আলোচনা করে। 🚀

| আদেশ | ব্যবহারের উদাহরণ |

|---|---|

| mainCamera.usePhysicalProperties | এই কমান্ডটি ইউনিটির ফিজিক্যাল ক্যামেরা বৈশিষ্ট্যগুলি ব্যবহার করতে সক্ষম করে, যা ভার্চুয়াল এবং বাস্তব-বিশ্বের বস্তুগুলিকে সারিবদ্ধ করতে ফোকাল দৈর্ঘ্য এবং লেন্সের বিকৃতির উপর আরও সুনির্দিষ্ট নিয়ন্ত্রণের অনুমতি দেয়। |

| faceMesh.GetDetectedFaceTransform() | MediaPipe-এর ফেস মেশ থেকে শনাক্ত করা মুখের রূপান্তর ডেটা (অবস্থান এবং ঘূর্ণন) পুনরুদ্ধার করে, যা প্রকৃত মুখের উপর সঠিকভাবে ভার্চুয়াল হেড স্থাপনের জন্য গুরুত্বপূর্ণ। |

| UnityObjectToClipPos | একটি শেডার-নির্দিষ্ট ফাংশন যা একটি শীর্ষস্থানীয় অবস্থানকে অবজেক্ট স্পেস থেকে ক্লিপ স্পেসে রূপান্তরিত করে, লেন্স বিকৃতি সংশোধন শেডারগুলিতে সারিবদ্ধকরণ নিশ্চিত করতে ব্যবহৃত হয়। |

| tex2D | একটি shader কমান্ড নির্দিষ্ট UV স্থানাঙ্কে একটি টেক্সচারের নমুনা দিতে ব্যবহৃত হয়, ক্যামেরা ফিডে বিকৃতি সংশোধন প্রয়োগের জন্য অপরিহার্য। |

| length(distUV) | উৎপত্তি থেকে UV স্থানাঙ্কের ইউক্লিডীয় দূরত্ব গণনা করে, যা ধীরে ধীরে লেন্সের বিকৃতি সামঞ্জস্য প্রয়োগ করতে লিভারেজ করা হয়। |

| adjuster.virtualHead | একটি স্ক্রিপ্ট ভেরিয়েবল যা ভার্চুয়াল হেড গেমঅবজেক্টকে উল্লেখ করে, এটির অবস্থান এবং ঘূর্ণনকে মুখ ট্র্যাকিং ডেটার উপর ভিত্তি করে গতিশীলভাবে আপডেট করতে সক্ষম করে। |

| [TestFixture] | একটি NUnit বৈশিষ্ট্য যা একটি ক্লাসকে একটি পরীক্ষার ফিক্সচার হিসাবে চিহ্নিত করে, এটি সংকেত দেয় যে এটিতে ইউনিট পরীক্ষা রয়েছে। ভার্চুয়াল হেড অ্যালাইনমেন্ট লজিক যাচাই করার জন্য এটি কার্যকর। |

| Assert.AreEqual | ভার্চুয়াল হেড প্লেসমেন্ট কাঙ্ক্ষিত ফলাফলের সাথে মেলে তা নিশ্চিত করে ইউনিট পরীক্ষার সময় প্রত্যাশিত এবং প্রকৃত মান তুলনা করতে ব্যবহৃত একটি NUnit পদ্ধতি। |

| _DistortionStrength | একটি শেডার সম্পত্তি যা লেন্সের বিকৃতির তীব্রতা সামঞ্জস্য করে, বাস্তব এবং ভার্চুয়াল জগতের মধ্যে প্রান্তিককরণকে সূক্ষ্ম-টিউনিং করে। |

| Quaternion.Euler | ইউলার কোণের উপর ভিত্তি করে একটি ঘূর্ণন তৈরি করে, যা সাধারণত ইউনিটির 3D স্পেসে ভার্চুয়াল হেডের মতো বস্তুর সারিবদ্ধ করার জন্য ব্যবহৃত হয়। |

ইউনিটি এবং মিডিয়াপাইপের সাথে এআর সঠিকতা বৃদ্ধি করা

আমরা যে প্রথম স্ক্রিপ্টটি অন্বেষণ করেছি তা ইউনিটির শারীরিক ক্যামেরা বৈশিষ্ট্যগুলি ব্যবহার করার উপর ফোকাস করে৷ সক্ষম করে শারীরিক বৈশিষ্ট্য ব্যবহার করুন, আমরা বাস্তব-বিশ্বের অপটিক্সকে আরও ঘনিষ্ঠভাবে মেলাতে ক্যামেরার আচরণ সামঞ্জস্য করি। AR এর সাথে কাজ করার সময় এটি বিশেষভাবে গুরুত্বপূর্ণ, যেখানে ফোকাল দৈর্ঘ্য বা দৃশ্যের ক্ষেত্রের সামান্য অসঙ্গতিও ভার্চুয়াল বস্তুগুলিকে ভুলভাবে সাজানো দেখাতে পারে। উদাহরণস্বরূপ, 35 মিমি এর মতো একটি সুনির্দিষ্ট মানের ফোকাল দৈর্ঘ্য সেট করা ভার্চুয়াল হেডকে সনাক্ত করা মুখের সাথে সারিবদ্ধ করতে সহায়তা করতে পারে। এই সামঞ্জস্য দূরবর্তী বস্তুকে নিখুঁত ফোকাসে আনতে একটি টেলিস্কোপকে সূক্ষ্ম-টিউন করার মতো, যাতে AR অভিজ্ঞতা প্রাকৃতিক এবং নিমগ্ন বোধ করে। 📸

স্ক্রিপ্টের আরেকটি গুরুত্বপূর্ণ উপাদান হল সনাক্ত করা মুখের অবস্থান এবং ঘূর্ণন ব্যবহার করে পুনরুদ্ধার করা faceMesh.GetDetectedFaceTransform(). এই ফাংশনটি MediaPipe এর ফেস মেশ থেকে রিয়েল-টাইম আপডেট প্রদান করে, যা ব্যবহারকারীর গতিবিধির সাথে ভার্চুয়াল হেড সিঙ্ক্রোনাইজ করার জন্য অপরিহার্য। একটি ভিডিও গেম খেলার কল্পনা করুন যেখানে আপনার চরিত্রের মাথা আপনার নিজের সাথে সিঙ্কে চলে না; অভিজ্ঞতা বিরক্তিকর হবে. সঠিক প্রান্তিককরণ নিশ্চিত করার মাধ্যমে, এই স্ক্রিপ্টটি AR-কে একটি নতুনত্ব থেকে এমন একটি টুলে রূপান্তরিত করে যা ভার্চুয়াল মিটিং বা উন্নত গেমিংয়ের মতো অ্যাপ্লিকেশনগুলিকে সমর্থন করতে পারে।

দ্বিতীয় স্ক্রিপ্টটি শেডার প্রোগ্রামিং-এর মধ্যে তলিয়ে যায়, বিশেষ করে লেন্সের বিকৃতিকে সম্বোধন করে। শেডার ক্যামেরা ফিডে বিকৃতি সংশোধন করে, _DistortionStrength-এর মতো বৈশিষ্ট্যগুলি ব্যবহার করে কীভাবে UV স্থানাঙ্কগুলিকে টেক্সচারে ম্যাপ করা হয়। ওয়াইড-এঙ্গেল লেন্স বা অনন্য বিকৃতি প্রোফাইল সহ ক্যামেরাগুলির সাথে ডিল করার সময় এটি বিশেষভাবে কার্যকর। উদাহরণস্বরূপ, যদি একটি ভার্চুয়াল হেড কোণের উপর নির্ভর করে প্রকৃত মুখের চেয়ে বড় বা ছোট দেখায়, তবে বিকৃতি সেটিংস টুইক করা আরও ভাল প্রান্তিককরণ নিশ্চিত করে। এটি একটি ফানহাউস প্রভাব দূর করতে একটি আয়নার ফ্রেম সামঞ্জস্য করার মতো, প্রতিফলনগুলিকে আরও বাস্তবসম্মত করে তোলে। 🎨

অবশেষে, তৃতীয় স্ক্রিপ্ট থেকে ইউনিট পরীক্ষা সমাধানগুলিকে বৈধ করে। এই পরীক্ষাগুলি প্রকৃত ফলাফলের সাথে ভার্চুয়াল হেডের প্রত্যাশিত অবস্থান এবং ঘূর্ণনের তুলনা করে, বিভিন্ন অবস্থার অধীনে সমন্বয়গুলি ধরে রাখা নিশ্চিত করে। NUnit ব্যবহার করে দাবী করুন, ডেভেলপাররা সারিবদ্ধকরণ নিশ্চিত করতে বিভিন্ন পরিস্থিতির অনুকরণ করতে পারে, যেমন মাথা দ্রুত সরানো বা চরম কোণে কাত করা। উদাহরণস্বরূপ, বিকাশের সময়, আমি লক্ষ্য করেছি যে সারিবদ্ধকরণটি সামনের দিকে মুখ করার সময় ভাল কাজ করে কিন্তু মাথাটি পাশের দিকে ঘুরলে প্রবাহিত হয়। এই ইউনিট পরীক্ষাগুলি সমস্যাটিকে হাইলাইট করেছে এবং আরও উন্নতির নির্দেশনা দিয়েছে, শক্তিশালী এআর অ্যাপ্লিকেশন তৈরিতে পুঙ্খানুপুঙ্খ পরীক্ষার গুরুত্বকে শক্তিশালী করেছে। 🚀

ইউনিটি এবং মিডিয়াপাইপের সাথে এআর-এ ভার্চুয়াল অবজেক্ট প্লেসমেন্ট সামঞ্জস্য করা

সমাধান 1: FOV এবং লেন্সের বিকৃতি সামঞ্জস্য করতে ইউনিটির ফিজিক্যাল ক্যামেরা ব্যবহার করা

// Import necessary Unity librariesusing UnityEngine;using Mediapipe.Unity;public class VirtualHeadAdjuster : MonoBehaviour{public Camera mainCamera; // Assign Unity's physical camerapublic GameObject virtualHead; // Assign the virtual head prefabprivate MediapipeFaceMesh faceMesh; // MediaPipe's face mesh componentvoid Start(){// Enable Unity's physical cameramainCamera.usePhysicalProperties = true;mainCamera.focalLength = 35f; // Set a standard focal length}void Update(){if (faceMesh != null && faceMesh.IsTracking){// Update the virtual head's position and rotationTransform detectedHead = faceMesh.GetDetectedFaceTransform();virtualHead.transform.position = detectedHead.position;virtualHead.transform.rotation = detectedHead.rotation;}}}

ভার্চুয়াল হেড সারিবদ্ধকরণের জন্য বিকল্প সামঞ্জস্য অন্বেষণ

সমাধান 2: লেন্সের বিকৃতি ঠিক করতে একটি কাস্টম শেডার ব্যবহার করা

Shader "Custom/LensDistortionCorrection"{Properties{_DistortionStrength ("Distortion Strength", Float) = 0.5}SubShader{Pass{CGPROGRAM#pragma vertex vert#pragma fragment fragfloat _DistortionStrength;struct appdata{float4 vertex : POSITION;float2 uv : TEXCOORD0;};struct v2f{float4 pos : SV_POSITION;float2 uv : TEXCOORD0;};v2f vert (appdata v){v2f o;o.pos = UnityObjectToClipPos(v.vertex);o.uv = v.uv;return o;}fixed4 frag (v2f i) : SV_Target{float2 distUV = i.uv - 0.5;distUV *= 1.0 + _DistortionStrength * length(distUV);distUV += 0.5;return tex2D(_MainTex, distUV);}ENDCG}}}

ইউনিটির এআর প্রকল্পগুলিতে উন্নত সামঞ্জস্যের জন্য পরীক্ষা করা হচ্ছে

সমাধান 3: ভার্চুয়াল হেড অ্যালাইনমেন্টের জন্য ইউনিট পরীক্ষা বাস্তবায়ন

using NUnit.Framework;using UnityEngine;using Mediapipe.Unity;[TestFixture]public class VirtualHeadAlignmentTests{private VirtualHeadAdjuster adjuster;private GameObject testHead;[SetUp]public void Init(){GameObject cameraObject = new GameObject("MainCamera");adjuster = cameraObject.AddComponent<VirtualHeadAdjuster>();testHead = new GameObject("VirtualHead");adjuster.virtualHead = testHead;}[Test]public void TestVirtualHeadAlignment(){Vector3 expectedPosition = new Vector3(0, 1, 2);Quaternion expectedRotation = Quaternion.Euler(0, 45, 0);adjuster.virtualHead.transform.position = expectedPosition;adjuster.virtualHead.transform.rotation = expectedRotation;Assert.AreEqual(expectedPosition, testHead.transform.position);Assert.AreEqual(expectedRotation, testHead.transform.rotation);}}

উন্নত ক্রমাঙ্কন প্রযুক্তির মাধ্যমে এআর প্লেসমেন্ট পরিমার্জন

এআর অ্যালাইনমেন্ট সমস্যাগুলির একটি প্রায়ই উপেক্ষিত দিক হল ক্যামেরা ক্রমাঙ্কনের গুরুত্ব। এআর প্রজেক্টে একটি বাস্তবের উপর ভার্চুয়াল মাথা রাখার মতো, লেন্সের অন্তর্নিহিত পরামিতি একটি গুরুত্বপূর্ণ ভূমিকা পালন করুন। এই পরামিতিগুলির মধ্যে ফোকাল দৈর্ঘ্য, অপটিক্যাল কেন্দ্র এবং বিকৃতি সহগ অন্তর্ভুক্ত রয়েছে। এই মানগুলি সঠিক না হলে, ভার্চুয়াল হেড ভুলভাবে সংযোজিত বা বিকৃত হতে পারে। এটি মোকাবেলা করার জন্য, নির্দিষ্ট ডিভাইস ক্যামেরার জন্য এই পরামিতিগুলি গণনা করতে ক্রমাঙ্কন সরঞ্জামগুলি ব্যবহার করা যেতে পারে। উদাহরণস্বরূপ, OpenCV-এর মতো সফ্টওয়্যার সুনির্দিষ্ট ক্যামেরা ম্যাট্রিক্স এবং বিকৃতি প্রোফাইল তৈরি করতে শক্তিশালী ক্রমাঙ্কন ইউটিলিটি অফার করে। 📐

আরেকটি পদ্ধতির মধ্যে রয়েছে ইউনিটি'স লিভারেজিং পোস্ট-প্রসেসিং স্ট্যাক. ক্ষেত্রের গভীরতা বা রঙিন বিকৃতি সংশোধনের মতো প্রভাব প্রয়োগ করে, আপনি রেন্ডার করা ভার্চুয়াল হেড এবং বাস্তব-বিশ্বের পরিবেশের মধ্যে অসঙ্গতিগুলিকে মসৃণ করতে পারেন। পোস্ট-প্রসেসিং পলিশের একটি স্তর যুক্ত করে যা ভার্চুয়াল বস্তু এবং ভৌত স্থানগুলির মধ্যে ব্যবধান পূরণ করে। উদাহরণস্বরূপ, একটি সূক্ষ্ম অস্পষ্ট প্রভাব কঠোর প্রান্তগুলিকে কমিয়ে দিতে পারে যা ভুলত্রুটিগুলিকে লক্ষণীয় করে তোলে। এটি নিমজ্জিত অ্যাপ্লিকেশনগুলিতে বিশেষভাবে কার্যকর যেখানে ব্যবহারকারীরা দৃশ্যের উপর অত্যন্ত মনোযোগী।

অবশেষে, রানটাইমের সময় গতিশীল অভিযোজনের শক্তিকে অবমূল্যায়ন করবেন না। আপনার AR পাইপলাইনে মেশিন লার্নিং মডেলগুলি অন্তর্ভুক্ত করা সিস্টেমটিকে সময়ের সাথে সাথে প্লেসমেন্ট শিখতে এবং সামঞ্জস্য করতে দেয়। উদাহরণস্বরূপ, একটি AI মডেল ব্যবহারকারীর প্রতিক্রিয়া বিশ্লেষণ করতে পারে বা অসঙ্গতি সনাক্ত করতে পারে এবং গতিশীলভাবে প্রান্তিককরণটি সূক্ষ্ম-টিউন করতে পারে। এটি সিস্টেমটিকে আরও শক্তিশালী করে তোলে এবং আলো, ডিভাইসের কার্যকারিতা বা ব্যবহারকারীর আচরণের বৈচিত্র্যের সাথে মোকাবিলা করতে সক্ষম হয়। এই উন্নতিগুলি একটি নিরবচ্ছিন্ন AR অভিজ্ঞতা নিশ্চিত করে, যার ফলে ভার্চুয়াল এবং বাস্তব জগতগুলি সত্যিকারের একীভূত হয়৷ 🚀

মিডিয়াপাইপ এবং ইউনিটি এআর প্লেসমেন্ট সম্পর্কে সাধারণ প্রশ্ন

- কেন আমার ভার্চুয়াল মাথা আসল মুখের সাথে মিসলাইন করা হয়?

- সমস্যাটি প্রায়শই অনুপযুক্ত ক্যামেরা ক্রমাঙ্কন থেকে উদ্ভূত হয়। গণনা করতে OpenCV এর মত টুল ব্যবহার করে camera matrix এবং distortion coefficients ব্যাপকভাবে প্রান্তিককরণ উন্নত করতে পারে।

- AR সারিবদ্ধকরণে ফোকাল লেন্থের ভূমিকা কী?

- দ focal length ক্যামেরা কিভাবে একটি 2D সমতলে 3D পয়েন্ট প্রজেক্ট করে তা নির্ধারণ করে। ইউনিটির ফিজিক্যাল ক্যামেরা সেটিংসে এটি সামঞ্জস্য করা নির্ভুলতা বাড়াতে পারে।

- ইউনিটি কি লেন্সের বিকৃতি সংশোধন করতে পারে?

- হ্যাঁ, ইউনিটি বিকৃতি সংশোধনের জন্য শেডার সমর্থন করে। মত বৈশিষ্ট্য সহ একটি shader প্রয়োগ করুন _DistortionStrength আপনার লেন্স প্রোফাইলের উপর ভিত্তি করে সংশোধন কাস্টমাইজ করতে।

- আমি কিভাবে ভার্চুয়াল বস্তুর প্রান্তিককরণ পরীক্ষা করতে পারি?

- যেমন কমান্ড সহ NUnit এ ইউনিট পরীক্ষা ব্যবহার করা Assert.AreEqual আপনাকে বিভিন্ন অবস্থার অধীনে ভার্চুয়াল বস্তুর অবস্থান এবং ঘূর্ণন যাচাই করতে দেয়।

- পোস্ট-প্রসেসিং কি এআর প্রকল্পের জন্য প্রয়োজনীয়?

- বাধ্যতামূলক না হলেও, পোস্ট-প্রসেসিং ইফেক্ট পছন্দ করে depth of field এবং chromatic aberration এআর দৃশ্যের ভিজ্যুয়াল গুণমান এবং বাস্তবতাকে উন্নত করতে পারে।

- MediaPipe মুখ ছাড়া অন্য বস্তু সনাক্ত করতে পারে?

- হ্যাঁ, MediaPipe হাত, ভঙ্গি এবং এমনকি সামগ্রিক ট্র্যাকিংয়ের জন্য সমাধান সরবরাহ করে, এটিকে বিভিন্ন এআর ব্যবহারের ক্ষেত্রে বহুমুখী করে তোলে।

- ইউনিটি এআর অ্যাপ্লিকেশনের জন্য কোন হার্ডওয়্যার সবচেয়ে ভালো কাজ করে?

- উচ্চ-কার্যক্ষমতা সম্পন্ন GPU এবং সুনির্দিষ্ট ক্যামেরা সহ ডিভাইসগুলি আদর্শ। টুলের মত ARCore এবং ARKit আরও সামঞ্জস্য বাড়ায়।

- কেন নির্দিষ্ট কোণে প্রান্তিককরণ খারাপ?

- এটি ক্যামেরা এবং ভার্চুয়াল পরিবেশের মধ্যে দৃশ্যের ক্ষেত্রের অমিলের কারণে হতে পারে। ইউনিটি ক্যামেরার সামঞ্জস্য fieldOfView সম্পত্তি সাহায্য করতে পারে।

- শেডার্স কিভাবে এআর সারিবদ্ধতা উন্নত করে?

- শেডার্স রেন্ডারিং-এ রিয়েল-টাইম সামঞ্জস্য করার অনুমতি দেয়, যেমন বিকৃতি সংশোধন করা বা লেন্সের প্রভাব অনুকরণ করা, ভার্চুয়াল এবং বাস্তব বস্তুর মধ্যে আরও ভাল সিঙ্ক্রোনাইজেশন নিশ্চিত করা।

- এআর সিস্টেম কি সময়ের সাথে স্ব-সামঞ্জস্য করতে পারে?

- হ্যাঁ, মেশিন লার্নিং মডেলগুলিকে একীভূত করা সিস্টেমগুলিকে গতিশীলভাবে খাপ খাইয়ে নিতে সক্ষম করে, সময়ের সাথে সাথে সারিবদ্ধকরণ এবং কর্মক্ষমতা উন্নত করতে প্রতিক্রিয়া থেকে শেখে।

এআর সঠিকতা বৃদ্ধি করা: চূড়ান্ত চিন্তা

নিমগ্ন AR অভিজ্ঞতার জন্য ভার্চুয়াল এবং বাস্তব-জগতের বস্তুর মধ্যে সুনির্দিষ্ট সারিবদ্ধতা অর্জন করা অত্যন্ত গুরুত্বপূর্ণ। যত্নশীল ক্রমাঙ্কন এবং উন্নত কৌশলগুলির মাধ্যমে, লেন্সের বিকৃতি এবং অমিল ফোকাল দৈর্ঘ্যের মতো সমস্যাগুলি প্রশমিত করা যেতে পারে, আরও সঠিকতা এবং ব্যবহারকারীর সন্তুষ্টি নিশ্চিত করে।

ইউনিটির টুলস, মিডিয়াপাইপ অ্যালগরিদম এবং ডাইনামিক অ্যাডজাস্টমেন্ট একীভূত করা AR ডেভেলপারদের জন্য শক্তিশালী সমাধান অফার করে। এই উন্নতিগুলি গেমিং, ভার্চুয়াল মিটিং এবং এর বাইরের জন্য নতুন সম্ভাবনা আনলক করে, ডিজিটাল এবং শারীরিক জগতের একটি বিরামহীন মিশ্রণ সক্ষম করে৷ অধ্যবসায় এবং উদ্ভাবনের সাথে, AR সারিবদ্ধকরণ চ্যালেঞ্জগুলি পরিচালনাযোগ্য হয়ে ওঠে। 🚀

সূত্র এবং তথ্যসূত্র

- ইউনিটিতে মিডিয়াপাইপ ব্যবহার করার বিষয়ে বিস্তারিত তথ্য অফিসিয়াল মিডিয়াপাইপ ডকুমেন্টেশন থেকে উল্লেখ করা হয়েছে। এটা অন্বেষণ এখানে .

- ইউনিটির ক্যামেরা ক্রমাঙ্কন এবং শারীরিক বৈশিষ্ট্যগুলির নির্দেশিকা ইউনিটি ডকুমেন্টেশন সাইটে পাওয়া যাবে। ভিজিট করুন ইউনিটি ক্যামেরা সেটিংস আরো বিস্তারিত জানার জন্য

- এআর অ্যাপ্লিকেশন এবং লেন্স বিকৃতি সংশোধনের জন্য শেডার প্রোগ্রামিং শেডার বিকাশের নিবন্ধগুলি দ্বারা অনুপ্রাণিত হয়েছিল, যেমন Catlike কোডিং .

- Google-এর ARCore ডেভেলপার সাইট থেকে Android ডেভেলপমেন্টের জন্য ARCore ক্ষমতা এবং সীমাবদ্ধতা পর্যালোচনা করা হয়েছে। এ আরও জানুন গুগল এআরকোর .