Täielikult ühendatud kihtide demüstifitseerimine CNN-ides

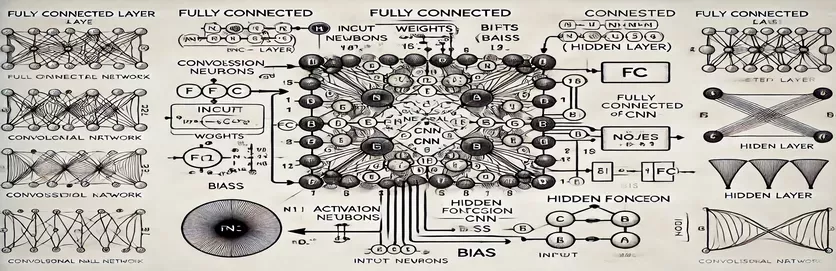

Konvolutsioonilise närvivõrgu (CNN) täielikult ühendatud (FC) kihi toimimise mõistmine võib tunduda nagu mõistatuse lahtiharutamine. Paljude jaoks seisneb keerukus arvutusprotsessis ja selles, kuidas peidetud kihi üks sõlm tuletatakse. Erinevalt traditsioonilistest tehisnärvivõrkudest (ANN-id) on CNN-ide FC-kihil nüansse, mis sageli õpetustes seletamata jäävad. Kui olete selle pärast hämmingus, pole te üksi!

Paljud ressursid liiguvad sellel teemal üle, jättes õppijad ilma selgete juhisteta. Õpetustes taaskasutatakse sageli mittetäielikke selgitusi, lisades selguse otsijate pettumust. Kui olete leidnud end korduvalt vastuseid otsimas, olete õiges kohas. 🧩

Selles juhendis keskendume ühe sõlme arvutamisele FC-kihi peidetud kihist. Kui olete ühe sõlme mehhanismist aru saanud, olete valmis ülejäänuga hakkama saama. Kui jagate selle protsessi selgeteks ja teostatavateks sammudeks, saate FC-kihi arvutustes navigeerimisel enesekindlust.

Kasutades seostatavaid näiteid ja otsest diagrammi, valgustame FC-kihi sisenditest väljunditeni. Jätke segadusega hüvasti ja tere mõistmisele – sukeldume sisse! 🚀

| Käsk | Kasutusnäide |

|---|---|

| np.dot() | Teostab punktkorrutise kahe massiivi vahel. Kasutatakse siin täielikult ühendatud kihi sõlme sisendite ja kaalude kaalutud summa arvutamiseks. |

| np.maximum() | Rakendab ReLU aktiveerimisfunktsiooni, valides maksimaalse väärtuse arvutatud väljundi ja nulli vahel. |

| torch.tensor() | Loob PyTorchis tensori. Tensorid on põhilised ehitusplokid andmete esitamiseks süvaõppe raamistikes. |

| torch.matmul() | Teeb PyTorchis maatriksi korrutamise. Kasutatakse sisendite ja kaalude vahelise punktkorrutise arvutamiseks. |

| torch.nn.functional.relu() | Rakendab PyTorchis ReLU aktiveerimisfunktsiooni, määrates kõik tensori negatiivsed väärtused nulliks. |

| np.testing.assert_array_almost_equal() | Võrdleb kaht massiivi elementide kaupa võrdsuse tagamiseks teatud tolerantsi piires. Kasulik numbriliste operatsioonide väljundi õigsuse testimiseks. |

| unittest.TestCase | Üksustesti mooduli baasklass testjuhtumite loomiseks. Kasutatakse Pythonis ühikutestide struktureerimiseks ja korraldamiseks. |

| np.array() | Loob NumPys massiivi. Massiive kasutatakse sisendite, kaalude ja eelarvamuste esitamiseks täielikult ühendatud kihi arvutustes. |

| torch.matmul() | PyTorchi funktsioon maatriksi korrutamiseks, mis on närvivõrkude väljundite arvutamisel ülioluline. |

| unittest.main() | Käivitab kõik skriptis määratletud testjuhtumid. Oluline rakendatud lahenduste täpsuse ja usaldusväärsuse kinnitamiseks. |

Täielikult ühendatud kihtide arvutuste jaotamine

Pakutud skriptide eesmärk on demüstifitseerida, kuidas sõlm a täielikult ühendatud (FC) CNN-i kiht töötleb eelmise kihi andmeid. Need kihid ühendavad iga sisendi iga sõlmega, kasutades kaalutud linke ja eelarvamusi, muutes need oluliseks selliste ülesannete jaoks nagu piltide klassifitseerimine. Esimene skript arvutab ühe sõlme väljundi kasutades NumPy. Sisendväärtuste korrutamisel neile vastavate kaaludega ja nihke liitmisel saadakse sõlme väljund. Seejärel juhitakse see väljund läbi aktiveerimisfunktsiooni (nt ReLU), et kehtestada mittelineaarsus. Kujutage näiteks ette pildi piksliväärtusi sisenditena; kaalud võivad esindada õpitud filtreid, mis eraldavad pildist tähendusrikkaid jooni. 🖼️

Teine skript üldistab arvutuse mitme sõlme jaoks. See kasutab maatriksi korrutamist, kus kaalud on esitatud 2D-maatriksina ja sisendid vektorina. See tõhus lähenemisviis võimaldab samaaegset arvutamist kõigi kihi sõlmede jaoks. Lisades eelarvamusi ja rakendades ReLU aktiveerimisfunktsiooni, saadakse kihi lõplikud väljundid. See meetod on väga skaleeritav ja on tänapäevaste süvaõppe raamistike põhitoiming. Näiteks näotuvastussüsteemis võib see protsess aidata kindlaks teha, kas tuvastatud kuju meenutab inimese nägu. 😊

Neile, kes töötavad süvaõppe raamatukogudega nagu PyTorch, kolmas skript demonstreerib, kuidas kasutada tensoreid ja sisseehitatud funktsioone samade arvutuste tegemiseks. PyTorchi paindlikkus ja sisseehitatud optimeerimised muudavad selle ideaalseks närvivõrkude ehitamiseks ja treenimiseks. Skript näitab, kuidas määratleda sisendeid, kaalusid ja nihkeid tensoritena ning teostada maatriksi korrutamist, kasutades torch.matmul() funktsiooni. See on eriti kasulik otspunktide torujuhtmete loomisel CNN-ide koolitamiseks suurte andmekogumitega, näiteks loomade tuvastamiseks metsloomade fotodel.

Lõpuks tagab üksuse testimise skript, et kõik rakendused töötavad erinevates tingimustes õigesti. Kasutades ühiktest teeki, kontrollib see arvutuste arvulist täpsust ja kinnitab, et väljundid vastavad oodatud tulemustele. See samm on otsustava tähtsusega silumiseks ja töökindluse tagamiseks, eriti CNN-ide juurutamisel reaalsetes rakendustes, nagu meditsiiniline pildianalüüs. Nende skriptide ja selgitustega on teil nüüd selge tee FC-kihtide enesekindlaks mõistmiseks ja rakendamiseks CNN-ides. 🚀

Täielikult ühendatud kihi sõlme arvutamise mõistmine

Pythoni-põhine lahendus, mis kasutab maatriksarvutuste jaoks NumPy-d

# Import necessary libraryimport numpy as np# Define inputs to the fully connected layer (e.g., from previous convolutional layers)inputs = np.array([0.5, 0.8, 0.2]) # Example inputs# Define weights for the first node in the hidden layerweights_node1 = np.array([0.4, 0.7, 0.3])# Define bias for the first nodebias_node1 = 0.1# Calculate the output for node 1node1_output = np.dot(inputs, weights_node1) + bias_node1# Apply an activation function (e.g., ReLU)node1_output = max(0, node1_output)# Print the resultprint(f"Output of Node 1: {node1_output}")

Sõlmede arvutamise üldistamine täielikult ühendatud kihtides

Pythonil põhinev lahendus kõigi peidetud kihi sõlmede arvutamiseks

# Import necessary libraryimport numpy as np# Define inputs to the fully connected layerinputs = np.array([0.5, 0.8, 0.2])# Define weights matrix (rows: nodes, columns: inputs)weights = np.array([[0.4, 0.7, 0.3], # Node 1[0.2, 0.9, 0.5]]) # Node 2# Define bias for each nodebiases = np.array([0.1, 0.2])# Calculate outputs for all nodesoutputs = np.dot(weights, inputs) + biases# Apply activation function (e.g., ReLU)outputs = np.maximum(0, outputs)# Print the resultsprint(f"Outputs of Hidden Layer: {outputs}")

PyTorchi kasutamine sõlmede arvutamiseks täielikult ühendatud kihis

Rakendus PyTorchiga süvaõppe entusiastidele

# Import PyTorchimport torch# Define inputs as a tensorinputs = torch.tensor([0.5, 0.8, 0.2])# Define weights and biasesweights = torch.tensor([[0.4, 0.7, 0.3], # Node 1[0.2, 0.9, 0.5]]) # Node 2biases = torch.tensor([0.1, 0.2])# Calculate outputsoutputs = torch.matmul(weights, inputs) + biases# Apply ReLU activationoutputs = torch.nn.functional.relu(outputs)# Print resultsprint(f"Outputs of Hidden Layer: {outputs}")

Testige iga lahendust ühiktestidega

Pythonil põhinevad ühikutestid juurutuste õigsuse tagamiseks

# Import unittest libraryimport unittest# Define the test case classclass TestNodeCalculation(unittest.TestCase):def test_single_node(self):inputs = np.array([0.5, 0.8, 0.2])weights_node1 = np.array([0.4, 0.7, 0.3])bias_node1 = 0.1expected_output = max(0, np.dot(inputs, weights_node1) + bias_node1)self.assertEqual(expected_output, 0.86)def test_multiple_nodes(self):inputs = np.array([0.5, 0.8, 0.2])weights = np.array([[0.4, 0.7, 0.3],[0.2, 0.9, 0.5]])biases = np.array([0.1, 0.2])expected_outputs = np.maximum(0, np.dot(weights, inputs) + biases)np.testing.assert_array_almost_equal(expected_outputs, np.array([0.86, 0.98]))# Run the testsif __name__ == "__main__":unittest.main()

Täielikult ühendatud kihtide tähtsuse lahtiharutamine CNN-ides

Täielikult ühendatud (FC) kihid mängivad keskset rolli konvolutsioonikihtidest eraldatud funktsioonide muutmisel lõplikeks ennustusteks. Need töötavad, ühendades iga sisendi iga väljundiga, pakkudes õpitud funktsioonide tihedat kaardistamist. Erinevalt konvolutsioonikihtidest, mis keskenduvad ruumilistele hierarhiatele, koondavad FC-kihid seda teavet, et teha selliseid otsuseid nagu objektide tuvastamine pildil. Näiteks isejuhtiva auto pildituvastussüsteemis võib FC-kiht määrata, kas tuvastatud objekt on jalakäija või tänavamärk. 🚗

Üks aspekt, mis FC kihte eristab, on nende võime üldistada treeningu käigus õpitud mustreid. See omadus on nähtamatute andmetega tegelemisel ülioluline. Iga kihi sõlm esindab unikaalset kaalude ja eelarvamuste kombinatsiooni, mis võimaldab sellel spetsialiseeruda konkreetsete mustrite või klasside tuvastamisele. Seetõttu määrab FC-kihtide struktuur sageli üldise mudeli täpsuse. Näiteks käsitsi kirjutatud numbrituvastusmudelis koondab FC kiht pikslimustrid numbrilisteks ennustusteks (0–9). ✍️

Kuigi FC-kihid on oma tihedate ühenduste tõttu arvutuslikult kallid, jäävad need üksikasjalikku klassifitseerimist nõudvate ülesannete jaoks oluliseks. Nende jõudluse optimeerimiseks, vältides liigset paigaldamist, kasutatakse kaasaegseid tehnikaid, nagu väljalangemine. Vähendades treeningu ajal aktiivsete sõlmede arvu, tagab väljalangemine, et FC-kiht õpib selgeks tugevad omadused, muutes selle asendamatuks sellistes rakendustes nagu näotuvastus ja meditsiiniline kujutise diagnostika.

Levinud küsimused täielikult ühendatud kihtide kohta

- Mis on täielikult ühendatud kihi põhifunktsioon CNN-ides?

- FC-kiht ühendab kõik sisendid väljunditega, koondades funktsioonid lõplikeks prognoosideks. See on võtmetähtsusega funktsioonide kaartide muutmisel kasutatavateks tulemusteks.

- Kuidas lähtestatakse kaalud ja kalded FC kihtides?

- Kaalud lähtestatakse sageli juhuslikult või kasutades selliseid tehnikaid nagu Xavieri lähtestamine, samas kui nihked algavad lihtsuse huvides tavaliselt nullist.

- Kuidas parandab ReLU aktiveerimine FC kihi jõudlust?

- ReLU rakendab mittelineaarsust, määrates negatiivsed väljundid nulliks. See hoiab ära kallakute kadumise, muutes mudeli kiiremaks.

- Kas katkestamist saab rakendada FC kihtidele?

- Jah, väljalangemine keelab sõlmed treeningu ajal juhuslikult, suurendades mudeli üldistamist ja vähendades ülepaigutamist.

- Mille poolest erinevad FC kihid konvolutsioonikihtidest?

- Kui konvolutsioonilised kihid eraldavad ruumilisi tunnuseid, siis FC-kihid koondavad need omadused klassifitseerimiseks tihedasse vormingusse.

Täielikult ühendatud kihtide võtmed

Täielikult ühendatud kiht koondab õpitud funktsioonid rakendatavateks ennustusteks, mis on närvivõrkude lõplik otsustusetapp. Mõistes, kuidas iga sõlme arvutatakse, saavad kasutajad kindlustunde CNN-i arhitektuuride kujundamisel ja optimeerimisel selliste ülesannete jaoks nagu objektide tuvastamine ja klassifitseerimine.

Praktilised näited, nagu pildituvastus autonoomsetes sõidukites või näotuvastus, näitavad FC-kihtide tähtsust. Õige lähenemisviisi korral tagab optimeerimismeetodite kaasamine tugevad ja täpsed mudelid, mis kohanduvad hästi nähtamatute andmetega. Selle kontseptsiooni valdamine avab tehisintellekti sügavama uurimise. 😊

Allikad ja viited

- Üksikasjalik selgitus täielikult ühendatud kihtide kohta CNN-ides, mis pärinevad veebisaidilt Masinõppe meisterlikkus .

- Põhjalik juhend aktiveerimisfunktsioonide ja nende rakenduste kohta Analüütika Vidhya .

- Ülevaateid väljalangemise ja närvivõrkude optimeerimistehnikate kohta leiate aadressilt DeepAI .

- Närvivõrkude kaalude ja eelarvamuste mõistmine alates Andmeteaduse poole .

- ReLU aktiveerimisfunktsioonide kasutamine PyTorchis allikas PyTorchi dokumentatsioon .