AR વિકાસ માટે વર્ચ્યુઅલ હેડ પ્લેસમેન્ટમાં પડકારો

ઓગમેન્ટેડ રિયાલિટી (AR) પ્રોજેક્ટ પર કામ કરવું રોમાંચક અને પડકારજનક બંને હોઈ શકે છે. યુનિટી સાથે એન્ડ્રોઇડ એપ્લિકેશન વિકસાવતી વખતે, મેં વાસ્તવિક દુનિયાના ચહેરાઓ પર વર્ચ્યુઅલ હેડ મૂકીને ડિજિટલ અને વાસ્તવિક દુનિયાને એકીકૃત રીતે મિશ્રિત કરવાનું લક્ષ્ય રાખ્યું હતું. ઇમર્સિવ અનુભવ બનાવવા માટે આ સુવિધા ચોકસાઇ પર ખૂબ આધાર રાખે છે. 🕶️

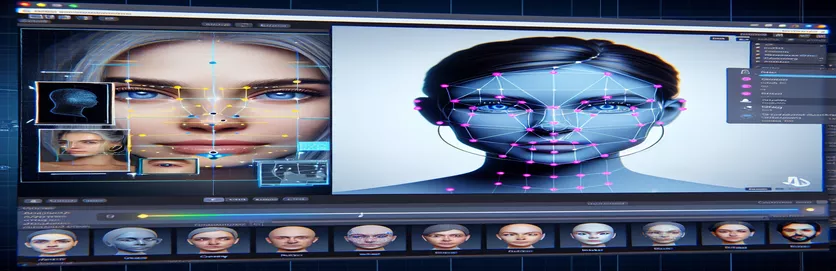

આ હાંસલ કરવા માટે, મેં આંખો, નાક અને મોં જેવા ચહેરાના સીમાચિહ્નો શોધવા માટે Google ના MediaPipe નો ઉપયોગ કર્યો. વર્ચ્યુઅલ હેડ પછી જનરેટ કરવામાં આવ્યું હતું અને આ મુખ્ય મુદ્દાઓના આધારે મૂકવામાં આવ્યું હતું. આધુનિક સાધનો AR શક્યતાઓને કેવી રીતે પરિવર્તિત કરી શકે છે તે જોવું રસપ્રદ હતું, પરંતુ પ્રવાસ સંપૂર્ણથી દૂર હતો.

જ્યારે વર્ચ્યુઅલ હેડ અપેક્ષા મુજબ વાસ્તવિક ચહેરા સાથે સંરેખિત નહોતું ત્યારે સમસ્યા ઊભી થઈ. એંગલ અથવા ઉપકરણથી કોઈ વાંધો નથી, પ્લેસમેન્ટ હંમેશા થોડી "બંધ" હતી, જે અકુદરતી અસર તરફ દોરી જાય છે. એવું હતું કે વર્ચ્યુઅલ રજૂઆત વાસ્તવિકતાથી ડિસ્કનેક્ટ થઈ ગઈ હતી. આનાથી સમસ્યાનિવારણ પ્રયોગોની શ્રેણી શરૂ થઈ.

Unity ના કેમેરા સેટિંગ્સને ટ્વિક કરવાથી લઈને MediaPipe ના અલ્ગોરિધમ સાથે પ્રયોગ કરવા સુધી, દરેક પ્રયાસે વધતા જતા સુધારાઓ લાવ્યા પરંતુ કોઈ ચોક્કસ ઉકેલ નથી. આ લેખ સમસ્યાના મૂળમાં, શીખેલા પાઠો અને સમાન પડકારોનો સામનો કરી રહેલા વિકાસકર્તાઓ માટે સંભવિત ઉકેલોમાં ડૂબકી લગાવે છે. 🚀

| આદેશ | ઉપયોગનું ઉદાહરણ |

|---|---|

| mainCamera.usePhysicalProperties | આ આદેશ યુનિટીના ભૌતિક કેમેરા ગુણધર્મોના ઉપયોગને સક્ષમ કરે છે, જે વર્ચ્યુઅલ અને વાસ્તવિક દુનિયાની વસ્તુઓને સંરેખિત કરવા માટે ફોકલ લંબાઈ અને લેન્સ વિકૃતિ પર વધુ ચોક્કસ નિયંત્રણ માટે પરવાનગી આપે છે. |

| faceMesh.GetDetectedFaceTransform() | મીડિયાપાઇપના ફેસ મેશમાંથી શોધાયેલ ચહેરાના ટ્રાન્સફોર્મ ડેટા (સ્થિતિ અને પરિભ્રમણ)ને પુનઃપ્રાપ્ત કરે છે, જે વાસ્તવિક ચહેરાઓ પર ચોક્કસ રીતે વર્ચ્યુઅલ હેડ મૂકવા માટે નિર્ણાયક છે. |

| UnityObjectToClipPos | શેડર-વિશિષ્ટ ફંક્શન કે જે એક શિરોબિંદુ સ્થાનને ઑબ્જેક્ટ સ્પેસમાંથી ક્લિપ સ્પેસમાં રૂપાંતરિત કરે છે, ગોઠવણીને સુનિશ્ચિત કરવા માટે લેન્સ વિકૃતિ સુધારણા શેડર્સમાં વપરાય છે. |

| tex2D | ઉલ્લેખિત યુવી કોઓર્ડિનેટ્સ પર ટેક્સચરના નમૂના લેવા માટે ઉપયોગમાં લેવાતો શેડર આદેશ, કૅમેરા ફીડ્સમાં વિકૃતિ સુધારણા લાગુ કરવા માટે જરૂરી છે. |

| length(distUV) | મૂળથી યુવી કોઓર્ડિનેટ્સના યુક્લિડિયન અંતરની ગણતરી કરે છે, જે લેન્સના વિકૃતિ ગોઠવણોને ક્રમશઃ લાગુ કરવા માટે લીવરેજ કરવામાં આવે છે. |

| adjuster.virtualHead | વર્ચ્યુઅલ હેડ ગેમઓબ્જેક્ટનો ઉલ્લેખ કરતી સ્ક્રિપ્ટ વેરીએબલ, તેની સ્થિતિ અને પરિભ્રમણને ચહેરાના ટ્રેકિંગ ડેટાના આધારે ગતિશીલ રીતે અપડેટ કરવામાં સક્ષમ બનાવે છે. |

| [TestFixture] | એક NUnit એટ્રિબ્યુટ કે જે ક્લાસને ટેસ્ટ ફિક્સ્ચર તરીકે ચિહ્નિત કરે છે, તે સંકેત આપે છે કે તેમાં એકમ પરીક્ષણો છે. આ વર્ચ્યુઅલ હેડ સંરેખણ તર્કને ચકાસવા માટે ઉપયોગી છે. |

| Assert.AreEqual | વર્ચ્યુઅલ હેડ પ્લેસમેન્ટ ઇચ્છિત પરિણામો સાથે મેળ ખાય છે તેની ખાતરી કરવા માટે, યુનિટ પરીક્ષણ દરમિયાન અપેક્ષિત અને વાસ્તવિક મૂલ્યોની તુલના કરવા માટે ઉપયોગમાં લેવાતી NUnit પદ્ધતિ. |

| _DistortionStrength | એક શેડર પ્રોપર્ટી કે જે લેન્સ વિકૃતિની તીવ્રતાને સમાયોજિત કરે છે, વાસ્તવિક અને વર્ચ્યુઅલ વિશ્વ વચ્ચે ગોઠવણીને ફાઇન-ટ્યુનિંગ કરે છે. |

| Quaternion.Euler | યુલર એંગલ પર આધારિત પરિભ્રમણ બનાવે છે, જે સામાન્ય રીતે યુનિટીના 3D સ્પેસમાં વર્ચ્યુઅલ હેડ જેવા ઑબ્જેક્ટને ગોઠવવા માટે વપરાય છે. |

યુનિટી અને મીડિયાપાઈપ વડે AR ચોકસાઈ વધારવી

અમે અન્વેષણ કરેલ પ્રથમ સ્ક્રિપ્ટ યુનિટીના ભૌતિક કેમેરા ગુણધર્મોના ઉપયોગ પર ધ્યાન કેન્દ્રિત કરે છે. સક્ષમ કરીને ભૌતિક ગુણધર્મોનો ઉપયોગ કરો, અમે વાસ્તવિક દુનિયાના ઓપ્ટિક્સને વધુ નજીકથી મેચ કરવા માટે કેમેરાના વર્તનને સમાયોજિત કરીએ છીએ. AR સાથે કામ કરતી વખતે આ ખાસ કરીને મહત્વનું છે, જ્યાં ફોકલ લેન્થ અથવા વ્યુના ક્ષેત્રમાં થોડી વિસંગતતાઓ પણ વર્ચ્યુઅલ ઑબ્જેક્ટ્સને ખોટી રીતે સંકલિત કરી શકે છે. ઉદાહરણ તરીકે, ફોકલ લેન્થને 35mm જેવા ચોક્કસ મૂલ્ય પર સેટ કરવાથી વર્ચ્યુઅલ હેડને શોધાયેલ ચહેરા સાથે સંરેખિત કરવામાં મદદ મળી શકે છે. આ ગોઠવણ દૂરની વસ્તુઓને સંપૂર્ણ ફોકસમાં લાવવા માટે ટેલિસ્કોપને ફાઇન-ટ્યુનિંગ સમાન છે, એ સુનિશ્ચિત કરે છે કે AR અનુભવ કુદરતી અને ઇમર્સિવ લાગે. 📸

સ્ક્રિપ્ટનો બીજો નિર્ણાયક ઘટક શોધાયેલ ચહેરાની સ્થિતિ અને પરિભ્રમણનો ઉપયોગ કરીને પુનઃપ્રાપ્ત કરવાનું છે faceMesh.GetDetectedFaceTransform(). આ ફંક્શન MediaPipeના ફેસ મેશમાંથી રીઅલ-ટાઇમ અપડેટ્સ પ્રદાન કરે છે, જે વપરાશકર્તાની હિલચાલ સાથે વર્ચ્યુઅલ હેડને સિંક્રનાઇઝ કરવા માટે જરૂરી છે. એવી વિડિયો ગેમ રમવાની કલ્પના કરો જ્યાં તમારા પાત્રનું માથું તમારા પોતાના સાથે સુમેળમાં ન ફરે; અનુભવ કંટાળાજનક હશે. ચોક્કસ સંરેખણની ખાતરી કરીને, આ સ્ક્રિપ્ટ એઆરને નવીનતામાંથી એક સાધનમાં પરિવર્તિત કરે છે જે વર્ચ્યુઅલ મીટિંગ્સ અથવા અદ્યતન ગેમિંગ જેવી એપ્લિકેશનને સપોર્ટ કરી શકે છે.

બીજી સ્ક્રિપ્ટ શેડર પ્રોગ્રામિંગની શોધ કરે છે, ખાસ કરીને લેન્સ વિકૃતિને સંબોધિત કરે છે. શેડર કેમેરા ફીડમાં વિકૃતિઓને સુધારે છે, _DistortionStrength જેવા ગુણધર્મોનો ઉપયોગ કરીને યુવી કોઓર્ડિનેટ્સ ટેક્સચર પર કેવી રીતે મેપ કરવામાં આવે છે. વિશિષ્ટ વિકૃતિ પ્રોફાઇલવાળા વાઇડ-એંગલ લેન્સ અથવા કેમેરા સાથે કામ કરતી વખતે આ ખાસ કરીને ઉપયોગી છે. દાખલા તરીકે, જો કોઈ વર્ચ્યુઅલ હેડ એંગલના આધારે વાસ્તવિક ચહેરા કરતાં મોટું કે નાનું દેખાય છે, તો વિકૃતિ સેટિંગ્સને ટ્વિક કરવાથી વધુ સારી ગોઠવણી સુનિશ્ચિત થાય છે. તે ફનહાઉસ અસરને દૂર કરવા માટે અરીસાની ફ્રેમને સમાયોજિત કરવા જેવું છે, પ્રતિબિંબને વધુ વાસ્તવિક બનાવે છે. 🎨

છેલ્લે, ત્રીજી સ્ક્રિપ્ટમાંથી એકમ પરીક્ષણો ઉકેલોને માન્ય કરે છે. આ પરીક્ષણો વાસ્તવિક પરિણામો સાથે વર્ચ્યુઅલ હેડની અપેક્ષિત સ્થિતિ અને પરિભ્રમણની તુલના કરે છે, વિવિધ પરિસ્થિતિઓમાં ગોઠવણો ચાલુ રહે તેની ખાતરી કરે છે. NUnit નો ઉપયોગ કરવો Assert.AreEqual, વિકાસકર્તાઓ વિવિધ દૃશ્યોનું અનુકરણ કરી શકે છે, જેમ કે માથું ઝડપથી ખસેડવું અથવા તેને આત્યંતિક ખૂણા પર નમવું, સંરેખણની પુષ્ટિ કરવા માટે. ઉદાહરણ તરીકે, વિકાસ દરમિયાન, મેં નોંધ્યું કે જ્યારે આગળનો સામનો કરવો પડે ત્યારે સંરેખણ સારી રીતે કામ કરે છે પરંતુ જ્યારે માથું બાજુ તરફ વળે છે ત્યારે તે વહી જાય છે. આ એકમ પરીક્ષણોએ મુદ્દાને પ્રકાશિત કર્યો અને વધુ સુધારાઓનું માર્ગદર્શન આપ્યું, મજબૂત AR એપ્લિકેશનો બનાવવા માટે સંપૂર્ણ પરીક્ષણના મહત્વને વધુ મજબૂત બનાવ્યું. 🚀

યુનિટી અને મીડિયાપાઈપ સાથે એઆરમાં વર્ચ્યુઅલ ઑબ્જેક્ટ પ્લેસમેન્ટને સમાયોજિત કરવું

ઉકેલ 1: FOV અને લેન્સ વિકૃતિને સમાયોજિત કરવા માટે યુનિટીના ભૌતિક કેમેરાનો ઉપયોગ કરવો

// Import necessary Unity librariesusing UnityEngine;using Mediapipe.Unity;public class VirtualHeadAdjuster : MonoBehaviour{public Camera mainCamera; // Assign Unity's physical camerapublic GameObject virtualHead; // Assign the virtual head prefabprivate MediapipeFaceMesh faceMesh; // MediaPipe's face mesh componentvoid Start(){// Enable Unity's physical cameramainCamera.usePhysicalProperties = true;mainCamera.focalLength = 35f; // Set a standard focal length}void Update(){if (faceMesh != null && faceMesh.IsTracking){// Update the virtual head's position and rotationTransform detectedHead = faceMesh.GetDetectedFaceTransform();virtualHead.transform.position = detectedHead.position;virtualHead.transform.rotation = detectedHead.rotation;}}}

વર્ચ્યુઅલ હેડ સંરેખણ માટે વૈકલ્પિક ગોઠવણોની શોધખોળ

ઉકેલ 2: લેન્સ વિકૃતિને સુધારવા માટે કસ્ટમ શેડરનો ઉપયોગ કરવો

Shader "Custom/LensDistortionCorrection"{Properties{_DistortionStrength ("Distortion Strength", Float) = 0.5}SubShader{Pass{CGPROGRAM#pragma vertex vert#pragma fragment fragfloat _DistortionStrength;struct appdata{float4 vertex : POSITION;float2 uv : TEXCOORD0;};struct v2f{float4 pos : SV_POSITION;float2 uv : TEXCOORD0;};v2f vert (appdata v){v2f o;o.pos = UnityObjectToClipPos(v.vertex);o.uv = v.uv;return o;}fixed4 frag (v2f i) : SV_Target{float2 distUV = i.uv - 0.5;distUV *= 1.0 + _DistortionStrength * length(distUV);distUV += 0.5;return tex2D(_MainTex, distUV);}ENDCG}}}

યુનિટીના એઆર પ્રોજેક્ટ્સમાં ઉન્નત સુસંગતતા માટે પરીક્ષણ

ઉકેલ 3: વર્ચ્યુઅલ હેડ સંરેખણ માટે એકમ પરીક્ષણોનો અમલ

using NUnit.Framework;using UnityEngine;using Mediapipe.Unity;[TestFixture]public class VirtualHeadAlignmentTests{private VirtualHeadAdjuster adjuster;private GameObject testHead;[SetUp]public void Init(){GameObject cameraObject = new GameObject("MainCamera");adjuster = cameraObject.AddComponent<VirtualHeadAdjuster>();testHead = new GameObject("VirtualHead");adjuster.virtualHead = testHead;}[Test]public void TestVirtualHeadAlignment(){Vector3 expectedPosition = new Vector3(0, 1, 2);Quaternion expectedRotation = Quaternion.Euler(0, 45, 0);adjuster.virtualHead.transform.position = expectedPosition;adjuster.virtualHead.transform.rotation = expectedRotation;Assert.AreEqual(expectedPosition, testHead.transform.position);Assert.AreEqual(expectedRotation, testHead.transform.rotation);}}

ઉન્નત કેલિબ્રેશન તકનીકો દ્વારા એઆર પ્લેસમેન્ટને શુદ્ધ કરવું

AR સંરેખણ મુદ્દાઓનું એક વારંવાર અવગણવામાં આવતું પાસું એ કેમેરા કેલિબ્રેશનનું મહત્વ છે. એઆર પ્રોજેક્ટ્સમાં વાસ્તવિક પર વર્ચ્યુઅલ હેડ મૂકવા જેવા, લેન્સના આંતરિક પરિમાણો મહત્વપૂર્ણ ભૂમિકા ભજવે છે. આ પરિમાણોમાં ફોકલ લંબાઈ, ઓપ્ટિકલ સેન્ટર અને વિકૃતિ ગુણાંકનો સમાવેશ થાય છે. જ્યારે આ મૂલ્યો સચોટ ન હોય, ત્યારે વર્ચ્યુઅલ હેડ ખોટી રીતે સંકલિત અથવા વિકૃત દેખાઈ શકે છે. આને સંબોધવા માટે, ચોક્કસ ઉપકરણ કેમેરા માટે આ પરિમાણોની ગણતરી કરવા માટે કેલિબ્રેશન ટૂલ્સનો ઉપયોગ કરી શકાય છે. ઉદાહરણ તરીકે, OpenCV જેવા સૉફ્ટવેર ચોક્કસ કૅમેરા મેટ્રિસિસ અને વિકૃતિ પ્રોફાઇલ્સ જનરેટ કરવા માટે મજબૂત કેલિબ્રેશન ઉપયોગિતાઓ પ્રદાન કરે છે. 📐

અન્ય અભિગમમાં યુનિટીનો લાભ લેવાનો સમાવેશ થાય છે પોસ્ટ-પ્રોસેસિંગ સ્ટેક. ડેપ્થ ઓફ ફીલ્ડ અથવા ક્રોમેટિક એબરેશન કરેક્શન જેવી અસરો લાગુ કરીને, તમે રેન્ડર કરેલ વર્ચ્યુઅલ હેડ અને વાસ્તવિક-વિશ્વ પર્યાવરણ વચ્ચેની વિસંગતતાઓને સરળ બનાવી શકો છો. પોસ્ટ-પ્રોસેસિંગ પોલિશનો એક સ્તર ઉમેરે છે જે વર્ચ્યુઅલ ઑબ્જેક્ટ્સ અને ભૌતિક જગ્યાઓ વચ્ચેના અંતરને પુલ કરે છે. દાખલા તરીકે, સૂક્ષ્મ અસ્પષ્ટતાની અસર કઠોર ધારને ઘટાડી શકે છે જે ખોટી ગોઠવણીને ધ્યાનપાત્ર બનાવે છે. આ ખાસ કરીને ઇમર્સિવ એપ્લિકેશન્સમાં ઉપયોગી છે જ્યાં વપરાશકર્તાઓ દ્રશ્ય પર ખૂબ ધ્યાન કેન્દ્રિત કરે છે.

છેલ્લે, રનટાઇમ દરમિયાન ગતિશીલ અનુકૂલનની શક્તિને ઓછો અંદાજ ન આપો. તમારી AR પાઇપલાઇનમાં મશીન લર્નિંગ મૉડલ્સનો સમાવેશ કરવાથી સિસ્ટમને સમય જતાં પ્લેસમેન્ટ શીખવા અને ગોઠવવાની મંજૂરી મળી શકે છે. દાખલા તરીકે, AI મૉડલ વપરાશકર્તાના પ્રતિસાદનું પૃથ્થકરણ કરી શકે છે અથવા અસંગતતા શોધી શકે છે અને ગતિશીલ રીતે ગોઠવણીને ફાઇન-ટ્યુન કરી શકે છે. આ સિસ્ટમને વધુ મજબૂત બનાવે છે અને લાઇટિંગ, ઉપકરણ પ્રદર્શન અથવા વપરાશકર્તા વર્તનમાં વિવિધતા સાથે કામ કરવા સક્ષમ બનાવે છે. આ સુધારાઓ એક સીમલેસ AR અનુભવને સુનિશ્ચિત કરે છે, જે વર્ચ્યુઅલ અને વાસ્તવિક દુનિયાને ખરેખર એકીકૃત અનુભવે છે. 🚀

મીડિયાપાઇપ અને યુનિટી એઆર પ્લેસમેન્ટ વિશે સામાન્ય પ્રશ્નો

- શા માટે મારા વર્ચ્યુઅલ હેડને વાસ્તવિક ચહેરા સાથે ખોટી રીતે જોડવામાં આવે છે?

- આ સમસ્યા ઘણીવાર અયોગ્ય કેમેરા કેલિબ્રેશનને કારણે ઉદ્ભવે છે. ની ગણતરી કરવા માટે OpenCV જેવા સાધનોનો ઉપયોગ કરીને camera matrix અને distortion coefficients મોટા પ્રમાણમાં સંરેખણ સુધારી શકે છે.

- AR ગોઠવણીમાં કેન્દ્રીય લંબાઈની ભૂમિકા શું છે?

- આ focal length કેમેરા 2D પ્લેન પર 3D પોઈન્ટ કેવી રીતે પ્રોજેક્ટ કરે છે તે વ્યાખ્યાયિત કરે છે. યુનિટીના ભૌતિક કેમેરા સેટિંગ્સમાં તેને સમાયોજિત કરવાથી સચોટતા વધી શકે છે.

- શું યુનિટી લેન્સ વિકૃતિ સુધારણાને નિયંત્રિત કરી શકે છે?

- હા, યુનિટી વિકૃતિ સુધારણા માટે શેડર્સને સપોર્ટ કરે છે. જેવા ગુણધર્મો સાથે શેડર લાગુ કરો _DistortionStrength તમારી લેન્સ પ્રોફાઇલના આધારે સુધારાઓને કસ્ટમાઇઝ કરવા માટે.

- હું વર્ચ્યુઅલ ઑબ્જેક્ટ્સની ગોઠવણી કેવી રીતે ચકાસી શકું?

- જેવા આદેશો સાથે NUnit માં એકમ પરીક્ષણોનો ઉપયોગ કરવો Assert.AreEqual તમને વિવિધ પરિસ્થિતિઓ હેઠળ વર્ચ્યુઅલ ઑબ્જેક્ટ્સની સ્થિતિ અને પરિભ્રમણને માન્ય કરવાની મંજૂરી આપે છે.

- શું AR પ્રોજેક્ટ્સ માટે પોસ્ટ-પ્રોસેસિંગ જરૂરી છે?

- ફરજિયાત ન હોવા છતાં, પોસ્ટ-પ્રોસેસિંગ અસરો જેવી depth of field અને chromatic aberration એઆર દ્રશ્યોની દ્રશ્ય ગુણવત્તા અને વાસ્તવિકતાને વધારી શકે છે.

- શું MediaPipe ચહેરા સિવાયની વસ્તુઓ શોધી શકે છે?

- હા, MediaPipe હાથ, પોઝ અને સાકલ્યવાદી ટ્રેકિંગ માટે ઉકેલો પ્રદાન કરે છે, જે તેને વિવિધ AR ઉપયોગના કેસ માટે બહુમુખી બનાવે છે.

- યુનિટી એઆર એપ્લિકેશન માટે કયું હાર્ડવેર શ્રેષ્ઠ કામ કરે છે?

- ઉચ્ચ-પ્રદર્શન GPU અને ચોક્કસ કેમેરાવાળા ઉપકરણો આદર્શ છે. જેવા સાધનો ARCore અને ARKit વધુ સુસંગતતા વધારવા.

- ચોક્કસ ખૂણા પર ગોઠવણી શા માટે ખરાબ છે?

- આ કૅમેરા અને વર્ચ્યુઅલ વાતાવરણ વચ્ચે દૃશ્યના ક્ષેત્રમાં મેળ ખાતી ન હોવાને કારણે હોઈ શકે છે. યુનિટી કેમેરાની ગોઠવણ fieldOfView મિલકત મદદ કરી શકે છે.

- શેડર્સ એઆર ગોઠવણીને કેવી રીતે સુધારે છે?

- શેડર્સ રેન્ડરીંગ માટે રીઅલ-ટાઇમ એડજસ્ટમેન્ટ માટે પરવાનગી આપે છે, જેમ કે વિકૃતિઓને સુધારવી અથવા લેન્સ ઇફેક્ટનું અનુકરણ કરવું, વર્ચ્યુઅલ અને વાસ્તવિક વસ્તુઓ વચ્ચે વધુ સારી રીતે સુમેળ સુનિશ્ચિત કરવું.

- શું એઆર સિસ્ટમો સમય સાથે સ્વ-વ્યવસ્થિત થઈ શકે છે?

- હા, મશીન લર્નિંગ મોડલ્સને એકીકૃત કરવાથી સિસ્ટમોને ગતિશીલ રીતે અનુકૂલન કરવામાં સક્ષમ બનાવે છે, પ્રતિસાદમાંથી શીખીને સમય જતાં સંરેખણ અને પ્રદર્શન સુધારવા માટે.

AR ચોકસાઈ વધારવી: અંતિમ વિચારો

ઇમર્સિવ AR અનુભવો માટે વર્ચ્યુઅલ અને રીઅલ-વર્લ્ડ ઑબ્જેક્ટ્સ વચ્ચે ચોક્કસ સંરેખણ પ્રાપ્ત કરવું મહત્વપૂર્ણ છે. સાવચેતીપૂર્વક માપાંકન અને અદ્યતન તકનીકો દ્વારા, લેન્સ વિકૃતિ અને મેળ ન ખાતી કેન્દ્રીય લંબાઈ જેવી સમસ્યાઓને ઘટાડી શકાય છે, વધુ સારી ચોકસાઈ અને વપરાશકર્તા સંતોષની ખાતરી કરી શકાય છે.

યુનિટીના ટૂલ્સ, મીડિયાપાઈપ અલ્ગોરિધમ્સ અને ડાયનેમિક એડજસ્ટમેન્ટને એકીકૃત કરવાથી AR વિકાસકર્તાઓ માટે મજબૂત ઉકેલો મળે છે. આ સુધારાઓ ડિજિટલ અને ભૌતિક વિશ્વોના એકીકૃત મિશ્રણને સક્ષમ કરે છે, ગેમિંગ, વર્ચ્યુઅલ મીટિંગ્સ અને તેનાથી આગળની નવી શક્યતાઓને અનલૉક કરે છે. દ્રઢતા અને નવીનતા સાથે, AR સંરેખણના પડકારો વ્યવસ્થિત બને છે. 🚀

સ્ત્રોતો અને સંદર્ભો

- એકતામાં મીડિયાપાઇપનો ઉપયોગ કરવા વિશેની વિગતો સત્તાવાર મીડિયાપાઇપ દસ્તાવેજોમાંથી સંદર્ભિત કરવામાં આવી હતી. તેનું અન્વેષણ કરો અહીં .

- યુનિટીના કેમેરા કેલિબ્રેશન અને ભૌતિક ગુણધર્મો અંગેનું માર્ગદર્શન યુનિટી દસ્તાવેજીકરણ સાઇટ પર મળી શકે છે. મુલાકાત યુનિટી કેમેરા સેટિંગ્સ વધુ વિગતો માટે.

- એઆર એપ્લિકેશન્સ અને લેન્સ વિકૃતિ સુધારણા માટે શેડર પ્રોગ્રામિંગ શેડર ડેવલપમેન્ટ પરના લેખોથી પ્રેરિત છે, જેમ કે બિલાડી જેવું કોડિંગ .

- ARCore ક્ષમતાઓ અને Android વિકાસ માટેની મર્યાદાઓની સમીક્ષા Google ની ARCore ડેવલપર સાઇટ પરથી કરવામાં આવી હતી. પર વધુ જાણો Google ARCore .