एआर विकास के लिए वर्चुअल हेड प्लेसमेंट में चुनौतियाँ

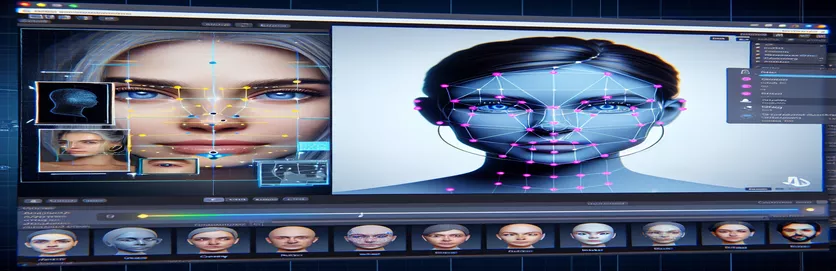

संवर्धित वास्तविकता (एआर) परियोजना पर काम करना रोमांचक और चुनौतीपूर्ण दोनों हो सकता है। यूनिटी के साथ एक एंड्रॉइड एप्लिकेशन विकसित करते समय, मेरा लक्ष्य वास्तविक दुनिया के चेहरों पर आभासी सिर रखकर डिजिटल और वास्तविक दुनिया को सहजता से मिश्रित करना था। यह सुविधा एक गहन अनुभव बनाने के लिए परिशुद्धता पर बहुत अधिक निर्भर करती है। 🕶️

इसे प्राप्त करने के लिए, मैंने आंखों, नाक और मुंह जैसे चेहरे के स्थलों का पता लगाने के लिए Google के मीडियापाइप का उपयोग किया। फिर इन प्रमुख बिंदुओं के आधार पर वर्चुअल हेड तैयार किया गया और रखा गया। यह देखना दिलचस्प था कि आधुनिक उपकरण एआर संभावनाओं को कैसे बदल सकते हैं, लेकिन यात्रा आदर्श से बहुत दूर थी।

समस्या तब उभरी जब आभासी सिर अपेक्षा के अनुरूप वास्तविक चेहरे के साथ संरेखित नहीं हुआ। कोई फर्क नहीं पड़ता कि कोण या उपकरण, प्लेसमेंट हमेशा थोड़ा "ऑफ" होता था, जिससे अप्राकृतिक प्रभाव पड़ता था। यह ऐसा था मानो आभासी प्रतिनिधित्व वास्तविकता से अलग हो गया हो। इससे समस्या निवारण प्रयोगों की एक श्रृंखला शुरू हो गई।

यूनिटी की कैमरा सेटिंग्स में बदलाव से लेकर मीडियापाइप के एल्गोरिदम के साथ प्रयोग करने तक, हर प्रयास में वृद्धिशील सुधार आए लेकिन कोई निश्चित समाधान नहीं मिला। यह आलेख समस्या के मूल, सीखे गए सबक और समान चुनौतियों का सामना करने वाले डेवलपर्स के लिए संभावित समाधानों पर प्रकाश डालता है। 🚀

| आज्ञा | उपयोग का उदाहरण |

|---|---|

| mainCamera.usePhysicalProperties | यह कमांड यूनिटी के भौतिक कैमरा गुणों के उपयोग को सक्षम बनाता है, जिससे आभासी और वास्तविक दुनिया की वस्तुओं को संरेखित करने के लिए फोकल लंबाई और लेंस विरूपण पर अधिक सटीक नियंत्रण की अनुमति मिलती है। |

| faceMesh.GetDetectedFaceTransform() | मीडियापाइप के फेस मेश से पहचाने गए चेहरे का ट्रांसफ़ॉर्म डेटा (स्थिति और रोटेशन) प्राप्त करता है, जो वास्तविक चेहरों पर वर्चुअल हेड्स को सटीक रूप से रखने के लिए महत्वपूर्ण है। |

| UnityObjectToClipPos | एक शेडर-विशिष्ट फ़ंक्शन जो ऑब्जेक्ट स्पेस से क्लिप स्पेस में शीर्ष स्थिति को बदलता है, संरेखण सुनिश्चित करने के लिए लेंस विरूपण सुधार शेडर्स में उपयोग किया जाता है। |

| tex2D | एक शेडर कमांड का उपयोग निर्दिष्ट यूवी निर्देशांक पर बनावट का नमूना लेने के लिए किया जाता है, जो कैमरा फ़ीड में विरूपण सुधार लागू करने के लिए आवश्यक है। |

| length(distUV) | मूल से यूवी निर्देशांक की यूक्लिडियन दूरी की गणना करता है, जिसका उपयोग क्रमिक लेंस विरूपण समायोजन लागू करने के लिए किया जाता है। |

| adjuster.virtualHead | वर्चुअल हेड गेमऑब्जेक्ट को संदर्भित करने वाला एक स्क्रिप्ट वैरिएबल, फेस ट्रैकिंग डेटा के आधार पर इसकी स्थिति और रोटेशन को गतिशील रूप से अपडेट करने में सक्षम बनाता है। |

| [TestFixture] | एक NUnit विशेषता जो एक वर्ग को परीक्षण स्थिरता के रूप में चिह्नित करती है, यह संकेत देती है कि इसमें इकाई परीक्षण शामिल हैं। यह वर्चुअल हेड अलाइनमेंट लॉजिक को सत्यापित करने के लिए उपयोगी है। |

| Assert.AreEqual | यूनिट परीक्षण के दौरान अपेक्षित और वास्तविक मूल्यों की तुलना करने के लिए एक एनयूनिट विधि का उपयोग किया जाता है, यह सुनिश्चित करते हुए कि वर्चुअल हेड प्लेसमेंट वांछित परिणामों से मेल खाता है। |

| _DistortionStrength | एक शेडर गुण जो लेंस विरूपण की तीव्रता को समायोजित करता है, वास्तविक और आभासी दुनिया के बीच संरेखण को ठीक करता है। |

| Quaternion.Euler | यूलर कोणों के आधार पर एक रोटेशन बनाता है, जिसका उपयोग आमतौर पर यूनिटी के 3डी स्पेस में वर्चुअल हेड जैसी वस्तुओं को संरेखित करने के लिए किया जाता है। |

यूनिटी और मीडियापाइप के साथ एआर सटीकता को बढ़ाना

हमारे द्वारा खोजी गई पहली स्क्रिप्ट यूनिटी के भौतिक कैमरा गुणों का उपयोग करने पर केंद्रित है। सक्षम करके भौतिक गुणों का उपयोग करें, हम वास्तविक दुनिया के प्रकाशिकी से अधिक निकटता से मेल खाने के लिए कैमरे के व्यवहार को समायोजित करते हैं। एआर के साथ काम करते समय यह विशेष रूप से महत्वपूर्ण है, जहां फोकल लंबाई या दृश्य क्षेत्र में मामूली विसंगतियां भी आभासी वस्तुओं को गलत तरीके से प्रदर्शित कर सकती हैं। उदाहरण के लिए, फोकल लंबाई को 35 मिमी जैसे सटीक मान पर सेट करने से वर्चुअल हेड को पहचाने गए चेहरे के साथ संरेखित करने में मदद मिल सकती है। यह समायोजन दूर की वस्तुओं को सही फोकस में लाने के लिए एक दूरबीन को ठीक करने के समान है, जिससे यह सुनिश्चित होता है कि एआर अनुभव प्राकृतिक और गहन लगता है। 📸

स्क्रिप्ट का एक अन्य महत्वपूर्ण घटक पहचाने गए चेहरे की स्थिति और रोटेशन का उपयोग करके पुनः प्राप्त करना है फेसमेश.गेटडिटेक्टेडफेसट्रांसफॉर्म(). यह फ़ंक्शन मीडियापाइप के फेस मेश से वास्तविक समय अपडेट प्रदान करता है, जो उपयोगकर्ता की गतिविधियों के साथ वर्चुअल हेड को सिंक्रनाइज़ करने के लिए आवश्यक है। एक वीडियो गेम खेलने की कल्पना करें जहां आपके चरित्र का सिर आपके साथ तालमेल में नहीं चलता है; अनुभव झकझोर देने वाला होगा. सटीक संरेखण सुनिश्चित करके, यह स्क्रिप्ट एआर को एक नवीनता से एक उपकरण में बदल देती है जो वर्चुअल मीटिंग या उन्नत गेमिंग जैसे अनुप्रयोगों का समर्थन कर सकती है।

दूसरी स्क्रिप्ट शेडर प्रोग्रामिंग में गहराई से उतरती है, विशेष रूप से लेंस विरूपण को संबोधित करती है। शेडर कैमरा फ़ीड में विकृतियों को ठीक करता है, _DistortionStrength जैसे गुणों का उपयोग करके यह हेरफेर करता है कि यूवी निर्देशांक बनावट पर कैसे मैप किए जाते हैं। वाइड-एंगल लेंस या अद्वितीय विरूपण प्रोफ़ाइल वाले कैमरों के साथ काम करते समय यह विशेष रूप से उपयोगी होता है। उदाहरण के लिए, यदि कोई आभासी सिर कोण के आधार पर वास्तविक चेहरे से बड़ा या छोटा दिखाई देता है, तो विरूपण सेटिंग्स को बदलने से बेहतर संरेखण सुनिश्चित होता है। यह फनहाउस प्रभाव को खत्म करने के लिए दर्पण के फ्रेम को समायोजित करने जैसा है, जिससे प्रतिबिंब अधिक यथार्थवादी बनते हैं। 🎨

अंत में, तीसरी स्क्रिप्ट से इकाई परीक्षण समाधानों को मान्य करते हैं। ये परीक्षण वास्तविक परिणामों के साथ वर्चुअल हेड की अपेक्षित स्थिति और रोटेशन की तुलना करते हैं, यह सुनिश्चित करते हुए कि समायोजन विभिन्न परिस्थितियों में होता है। NUnit का उपयोग करना दावा करें.समान हैं, डेवलपर्स संरेखण की पुष्टि करने के लिए विभिन्न परिदृश्यों का अनुकरण कर सकते हैं, जैसे सिर को तेजी से हिलाना या अत्यधिक कोणों पर झुकाना। उदाहरण के लिए, विकास के दौरान, मैंने देखा कि आगे की ओर मुंह करने पर संरेखण अच्छी तरह से काम करता है, लेकिन जब सिर बगल की ओर मुड़ता है तो संतुलन बिगड़ जाता है। इन इकाई परीक्षणों ने इस मुद्दे पर प्रकाश डाला और आगे के सुधारों का मार्गदर्शन किया, जिससे मजबूत एआर अनुप्रयोगों को बनाने में संपूर्ण परीक्षण के महत्व को बल मिला। 🚀

यूनिटी और मीडियापाइप के साथ एआर में वर्चुअल ऑब्जेक्ट प्लेसमेंट को समायोजित करना

समाधान 1: FOV और लेंस विरूपण को समायोजित करने के लिए यूनिटी के भौतिक कैमरे का उपयोग करना

// Import necessary Unity librariesusing UnityEngine;using Mediapipe.Unity;public class VirtualHeadAdjuster : MonoBehaviour{public Camera mainCamera; // Assign Unity's physical camerapublic GameObject virtualHead; // Assign the virtual head prefabprivate MediapipeFaceMesh faceMesh; // MediaPipe's face mesh componentvoid Start(){// Enable Unity's physical cameramainCamera.usePhysicalProperties = true;mainCamera.focalLength = 35f; // Set a standard focal length}void Update(){if (faceMesh != null && faceMesh.IsTracking){// Update the virtual head's position and rotationTransform detectedHead = faceMesh.GetDetectedFaceTransform();virtualHead.transform.position = detectedHead.position;virtualHead.transform.rotation = detectedHead.rotation;}}}

वर्चुअल हेड संरेखण के लिए वैकल्पिक समायोजन की खोज

समाधान 2: लेंस विरूपण को ठीक करने के लिए कस्टम शेडर का उपयोग करना

Shader "Custom/LensDistortionCorrection"{Properties{_DistortionStrength ("Distortion Strength", Float) = 0.5}SubShader{Pass{CGPROGRAM#pragma vertex vert#pragma fragment fragfloat _DistortionStrength;struct appdata{float4 vertex : POSITION;float2 uv : TEXCOORD0;};struct v2f{float4 pos : SV_POSITION;float2 uv : TEXCOORD0;};v2f vert (appdata v){v2f o;o.pos = UnityObjectToClipPos(v.vertex);o.uv = v.uv;return o;}fixed4 frag (v2f i) : SV_Target{float2 distUV = i.uv - 0.5;distUV *= 1.0 + _DistortionStrength * length(distUV);distUV += 0.5;return tex2D(_MainTex, distUV);}ENDCG}}}

यूनिटी की एआर परियोजनाओं में उन्नत अनुकूलता के लिए परीक्षण

समाधान 3: वर्चुअल हेड एलाइनमेंट के लिए यूनिट टेस्ट लागू करना

using NUnit.Framework;using UnityEngine;using Mediapipe.Unity;[TestFixture]public class VirtualHeadAlignmentTests{private VirtualHeadAdjuster adjuster;private GameObject testHead;[SetUp]public void Init(){GameObject cameraObject = new GameObject("MainCamera");adjuster = cameraObject.AddComponent<VirtualHeadAdjuster>();testHead = new GameObject("VirtualHead");adjuster.virtualHead = testHead;}[Test]public void TestVirtualHeadAlignment(){Vector3 expectedPosition = new Vector3(0, 1, 2);Quaternion expectedRotation = Quaternion.Euler(0, 45, 0);adjuster.virtualHead.transform.position = expectedPosition;adjuster.virtualHead.transform.rotation = expectedRotation;Assert.AreEqual(expectedPosition, testHead.transform.position);Assert.AreEqual(expectedRotation, testHead.transform.rotation);}}

उन्नत अंशांकन तकनीकों के माध्यम से एआर प्लेसमेंट को परिष्कृत करना

एआर संरेखण मुद्दों का अक्सर अनदेखा किया जाने वाला पहलू कैमरा अंशांकन का महत्व है। एआर परियोजनाओं में वास्तविक सिर के ऊपर आभासी सिर रखना, लेंस का होना आंतरिक पैरामीटर एक महत्वपूर्ण भूमिका निभाएं. इन मापदंडों में फोकल लंबाई, ऑप्टिकल केंद्र और विरूपण गुणांक शामिल हैं। जब ये मान सटीक नहीं होते हैं, तो वर्चुअल हेड गलत संरेखित या विकृत दिखाई दे सकता है। इसे संबोधित करने के लिए, विशिष्ट डिवाइस कैमरे के लिए इन मापदंडों की गणना करने के लिए अंशांकन उपकरण का उपयोग किया जा सकता है। उदाहरण के लिए, OpenCV जैसे सॉफ़्टवेयर सटीक कैमरा मैट्रिसेस और विरूपण प्रोफ़ाइल उत्पन्न करने के लिए मजबूत अंशांकन उपयोगिताएँ प्रदान करते हैं। 📐

एक अन्य दृष्टिकोण में एकता का लाभ उठाना शामिल है पोस्ट-प्रोसेसिंग स्टैक. क्षेत्र की गहराई या रंगीन विपथन सुधार जैसे प्रभावों को लागू करके, आप प्रस्तुत आभासी सिर और वास्तविक दुनिया के वातावरण के बीच विसंगतियों को दूर कर सकते हैं। पोस्ट-प्रोसेसिंग पॉलिश की एक परत जोड़ती है जो आभासी वस्तुओं और भौतिक स्थानों के बीच के अंतर को पाटती है। उदाहरण के लिए, एक सूक्ष्म धुंधला प्रभाव उन कठोर किनारों को कम कर सकता है जो गलत संरेखण को ध्यान देने योग्य बनाते हैं। यह विशेष रूप से इमर्सिव अनुप्रयोगों में उपयोगी है जहां उपयोगकर्ता दृश्य पर अत्यधिक ध्यान केंद्रित करते हैं।

अंत में, रनटाइम के दौरान गतिशील अनुकूलन की शक्ति को कम मत समझो। आपके एआर पाइपलाइन में मशीन लर्निंग मॉडल को शामिल करने से सिस्टम को समय के साथ प्लेसमेंट को सीखने और समायोजित करने की अनुमति मिल सकती है। उदाहरण के लिए, एक एआई मॉडल उपयोगकर्ता की प्रतिक्रिया का विश्लेषण कर सकता है या विसंगतियों का पता लगा सकता है और संरेखण को गतिशील रूप से ठीक कर सकता है। यह सिस्टम को अधिक मजबूत बनाता है और प्रकाश व्यवस्था, डिवाइस प्रदर्शन या उपयोगकर्ता व्यवहार में भिन्नता से निपटने में सक्षम बनाता है। ये सुधार एक सहज एआर अनुभव सुनिश्चित करते हैं, जिससे आभासी और वास्तविक दुनिया वास्तव में एकीकृत महसूस होती है। 🚀

मीडियापाइप और यूनिटी एआर प्लेसमेंट के बारे में सामान्य प्रश्न

- मेरा आभासी सिर वास्तविक चेहरे के साथ गलत संरेखित क्यों है?

- समस्या अक्सर अनुचित कैमरा अंशांकन के कारण उत्पन्न होती है। गणना करने के लिए OpenCV जैसे टूल का उपयोग करना camera matrix और distortion coefficients संरेखण में काफी सुधार हो सकता है।

- एआर संरेखण में फोकल लम्बाई की क्या भूमिका है?

- focal length यह परिभाषित करता है कि कैमरा 2डी विमान पर 3डी बिंदुओं को कैसे प्रोजेक्ट करता है। इसे यूनिटी की भौतिक कैमरा सेटिंग्स में समायोजित करने से सटीकता बढ़ सकती है।

- क्या एकता लेंस विरूपण सुधार को संभाल सकती है?

- हां, यूनिटी विरूपण सुधार के लिए शेडर्स का समर्थन करती है। जैसे गुणों वाला एक शेडर लागू करें _DistortionStrength आपके लेंस प्रोफाइल के आधार पर सुधारों को अनुकूलित करने के लिए।

- मैं आभासी वस्तुओं के संरेखण का परीक्षण कैसे कर सकता हूँ?

- जैसे कमांड के साथ NUnit में यूनिट परीक्षण का उपयोग करना Assert.AreEqual आपको विभिन्न परिस्थितियों में आभासी वस्तुओं की स्थिति और रोटेशन को मान्य करने की अनुमति देता है।

- क्या एआर परियोजनाओं के लिए पोस्ट-प्रोसेसिंग आवश्यक है?

- जबकि अनिवार्य नहीं है, पोस्ट-प्रोसेसिंग प्रभाव जैसे depth of field और chromatic aberration एआर दृश्यों की दृश्य गुणवत्ता और यथार्थवाद को बढ़ा सकता है।

- क्या मीडियापाइप चेहरों के अलावा अन्य वस्तुओं का पता लगा सकता है?

- हां, मीडियापाइप हाथों, मुद्रा और यहां तक कि समग्र ट्रैकिंग के लिए समाधान प्रदान करता है, जो इसे विभिन्न एआर उपयोग मामलों के लिए बहुमुखी बनाता है।

- यूनिटी एआर अनुप्रयोगों के लिए कौन सा हार्डवेयर सबसे अच्छा काम करता है?

- उच्च प्रदर्शन वाले जीपीयू और सटीक कैमरे वाले उपकरण आदर्श हैं। उपकरण जैसे ARCore और ARKit अनुकूलता को और बढ़ाएं।

- कुछ कोणों पर संरेखण ख़राब क्यों है?

- यह कैमरे और आभासी वातावरण के बीच दृश्य क्षेत्र में बेमेल के कारण हो सकता है। यूनिटी कैमरे का समायोजन fieldOfView संपत्ति से मदद मिल सकती है.

- शेडर्स एआर संरेखण को कैसे सुधारते हैं?

- शेडर्स प्रतिपादन के लिए वास्तविक समय समायोजन की अनुमति देते हैं, जैसे विकृतियों को ठीक करना या लेंस प्रभावों का अनुकरण करना, आभासी और वास्तविक वस्तुओं के बीच बेहतर सिंक्रनाइज़ेशन सुनिश्चित करना।

- क्या एआर सिस्टम समय के साथ स्व-समायोजित हो सकता है?

- हां, मशीन लर्निंग मॉडल को एकीकृत करने से सिस्टम को गतिशील रूप से अनुकूलित करने में सक्षम बनाता है, समय के साथ संरेखण और प्रदर्शन में सुधार करने के लिए फीडबैक से सीखता है।

एआर सटीकता बढ़ाना: अंतिम विचार

आभासी और वास्तविक दुनिया की वस्तुओं के बीच सटीक संरेखण प्राप्त करना इमर्सिव एआर अनुभवों के लिए महत्वपूर्ण है। सावधानीपूर्वक अंशांकन और उन्नत तकनीकों के माध्यम से, लेंस विरूपण और बेमेल फोकल लंबाई जैसे मुद्दों को कम किया जा सकता है, जिससे बेहतर सटीकता और उपयोगकर्ता संतुष्टि सुनिश्चित होती है।

यूनिटी के टूल, मीडियापाइप एल्गोरिदम और गतिशील समायोजन को एकीकृत करना एआर डेवलपर्स के लिए मजबूत समाधान प्रदान करता है। ये सुधार डिजिटल और भौतिक दुनिया के सहज मिश्रण को सक्षम करते हैं, जिससे गेमिंग, वर्चुअल मीटिंग और उससे आगे के लिए नई संभावनाएं खुलती हैं। दृढ़ता और नवीनता के साथ, एआर संरेखण चुनौतियाँ प्रबंधनीय हो जाती हैं। 🚀

स्रोत और सन्दर्भ

- यूनिटी में मीडियापाइप का उपयोग करने के बारे में विवरण आधिकारिक मीडियापाइप दस्तावेज़ से संदर्भित किया गया था। इसका अन्वेषण करें यहाँ .

- यूनिटी के कैमरा अंशांकन और भौतिक गुणों पर मार्गदर्शन यूनिटी दस्तावेज़ीकरण साइट पर पाया जा सकता है। मिलने जाना एकता कैमरा सेटिंग्स अधिक जानकारी के लिए.

- एआर अनुप्रयोगों और लेंस विरूपण सुधार के लिए शेडर प्रोग्रामिंग, शेडर विकास पर लेखों से प्रेरित थी, जैसे कि बिल्ली जैसी कोडिंग .

- Android विकास के लिए ARCore क्षमताओं और सीमाओं की समीक्षा Google की ARCore डेवलपर साइट से की गई। यहां और जानें गूगल एआरकोर .