एआर डेव्हलपमेंटसाठी व्हर्च्युअल हेड प्लेसमेंटमधील आव्हाने

ऑगमेंटेड रिॲलिटी (AR) प्रकल्पावर काम करणे रोमांचक आणि आव्हानात्मक दोन्ही असू शकते. Unity सह Android ऍप्लिकेशन विकसित करताना, वास्तविक-जगातील चेहऱ्यांवर आभासी डोके ठेवून डिजिटल आणि वास्तविक जग अखंडपणे मिसळण्याचे माझे ध्येय होते. इमर्सिव्ह अनुभव तयार करण्यासाठी हे वैशिष्ट्य अचूकतेवर खूप अवलंबून असते. 🕶️

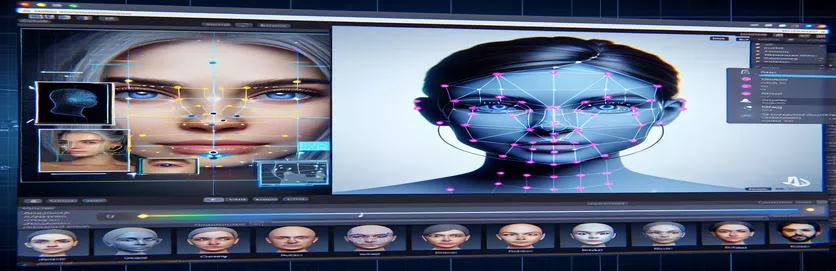

हे साध्य करण्यासाठी, डोळे, नाक आणि तोंड यांसारख्या चेहऱ्यावरील खुणा शोधण्यासाठी मी Google च्या MediaPipe चा वापर केला. त्यानंतर व्हर्च्युअल हेड तयार केले गेले आणि या मुख्य मुद्यांवर आधारित ठेवले गेले. आधुनिक साधने AR शक्यतांचे रूपांतर कसे करू शकतात हे पाहणे मनोरंजक होते, परंतु हा प्रवास परिपूर्ण नव्हता.

जेव्हा आभासी हेड अपेक्षेप्रमाणे वास्तविक चेहऱ्याशी संरेखित होत नाही तेव्हा समस्या उद्भवली. कोन किंवा उपकरण काहीही असले तरी, प्लेसमेंट नेहमी थोडा "बंद" होते, ज्यामुळे अनैसर्गिक परिणाम होतो. जणू व्हर्च्युअल प्रेझेंटेशन वास्तवापासून डिस्कनेक्ट झाले होते. यामुळे समस्यानिवारण प्रयोगांची मालिका सुरू झाली.

युनिटीच्या कॅमेरा सेटिंग्जमध्ये बदल करण्यापासून ते MediaPipe च्या अल्गोरिदमचा प्रयोग करण्यापर्यंत, प्रत्येक प्रयत्नाने वाढीव सुधारणा केल्या परंतु कोणतेही निश्चित समाधान नाही. हा लेख समस्येचा गाभा, शिकलेले धडे आणि तत्सम आव्हानांचा सामना करणाऱ्या विकासकांसाठी संभाव्य उपाय यांमध्ये डोकावतो. 🚀

| आज्ञा | वापराचे उदाहरण |

|---|---|

| mainCamera.usePhysicalProperties | ही आज्ञा युनिटीच्या भौतिक कॅमेरा गुणधर्मांचा वापर करण्यास सक्षम करते, ज्यामुळे व्हर्च्युअल आणि वास्तविक-जगातील वस्तू संरेखित करण्यासाठी फोकल लांबी आणि लेन्स विकृतीवर अधिक अचूक नियंत्रण मिळू शकते. |

| faceMesh.GetDetectedFaceTransform() | MediaPipe च्या फेस मेशमधून आढळलेल्या चेहऱ्याचा ट्रान्सफॉर्म डेटा (स्थिती आणि रोटेशन) पुनर्प्राप्त करते, वास्तविक चेहऱ्यांवर अचूकपणे आभासी डोके ठेवण्यासाठी महत्त्वपूर्ण. |

| UnityObjectToClipPos | शेडर-विशिष्ट फंक्शन जे व्हर्टेक्स स्थितीचे ऑब्जेक्ट स्पेसमधून क्लिप स्पेसमध्ये रूपांतर करते, संरेखन सुनिश्चित करण्यासाठी लेन्स विरूपण सुधारणा शेडर्समध्ये वापरले जाते. |

| tex2D | निर्दिष्ट UV निर्देशांकांवर टेक्सचरचा नमुना घेण्यासाठी वापरला जाणारा शेडर कमांड, कॅमेरा फीड्समध्ये विरूपण सुधारणा लागू करण्यासाठी आवश्यक आहे. |

| length(distUV) | उत्पत्तीपासून यूव्ही निर्देशांकांच्या युक्लिडियन अंतराची गणना करते, ज्याचा लेन्स विकृतीचे क्रमिक समायोजन लागू करण्यासाठी वापर केला जातो. |

| adjuster.virtualHead | व्हर्च्युअल हेड गेमऑब्जेक्टचा संदर्भ देणारे स्क्रिप्ट व्हेरिएबल, त्याची स्थिती आणि रोटेशन फेस ट्रॅकिंग डेटाच्या आधारे डायनॅमिकरित्या अपडेट करणे सक्षम करते. |

| [TestFixture] | एक NUnit विशेषता जे वर्गाला चाचणी फिक्स्चर म्हणून चिन्हांकित करते, त्यात युनिट चाचण्या आहेत हे सूचित करते. व्हर्च्युअल हेड अलाइनमेंट लॉजिक सत्यापित करण्यासाठी हे उपयुक्त आहे. |

| Assert.AreEqual | युनिट चाचणी दरम्यान अपेक्षित आणि वास्तविक मूल्यांची तुलना करण्यासाठी वापरलेली NUnit पद्धत, वर्च्युअल हेड प्लेसमेंट इच्छित परिणामांशी जुळते याची खात्री करून. |

| _DistortionStrength | एक शेडर गुणधर्म जी लेन्सच्या विकृतीची तीव्रता समायोजित करते, वास्तविक आणि आभासी जगांमधील संरेखन व्यवस्थित करते. |

| Quaternion.Euler | यूलर कोनांवर आधारित एक रोटेशन तयार करते, सामान्यत: युनिटीच्या 3D स्पेसमध्ये व्हर्च्युअल हेडसारख्या वस्तू संरेखित करण्यासाठी वापरले जाते. |

युनिटी आणि मीडियापाइपसह AR अचूकता वाढवणे

आम्ही एक्सप्लोर केलेली पहिली स्क्रिप्ट युनिटीच्या भौतिक कॅमेरा गुणधर्म वापरण्यावर लक्ष केंद्रित करते. सक्षम करून भौतिक गुणधर्म वापरा, रिअल-वर्ल्ड ऑप्टिक्सशी अधिक जवळून जुळण्यासाठी आम्ही कॅमेराचे वर्तन समायोजित करतो. AR सह कार्य करताना हे विशेषतः महत्वाचे आहे, जेथे फोकल लांबी किंवा दृश्याच्या क्षेत्रामध्ये अगदी थोडीशी विसंगती देखील आभासी वस्तू चुकीच्या संरेखित दिसू शकते. उदाहरणार्थ, 35mm सारख्या अचूक मूल्यावर फोकल लांबी सेट केल्याने व्हर्च्युअल हेड ओळखलेल्या चेहऱ्यासह संरेखित करण्यात मदत होऊ शकते. हे समायोजन दूरच्या वस्तूंना परिपूर्ण फोकसमध्ये आणण्यासाठी दुर्बिणीला बारीक-ट्यून करण्यासारखे आहे, AR अनुभव नैसर्गिक आणि विसर्जित असल्याचे सुनिश्चित करते. 📸

स्क्रिप्टचा आणखी एक महत्त्वाचा घटक म्हणजे शोधलेल्या चेहऱ्याची स्थिती आणि रोटेशन पुनर्प्राप्त करणे faceMesh.GetDetectedFaceTransform(). हे फंक्शन MediaPipe च्या फेस मेशमधून रिअल-टाइम अपडेट्स प्रदान करते, जे वापरकर्त्याच्या हालचालींसह व्हर्च्युअल हेड सिंक्रोनाइझ करण्यासाठी आवश्यक आहे. एक व्हिडिओ गेम खेळण्याची कल्पना करा जिथे तुमच्या पात्राचे डोके तुमच्या स्वतःच्या बरोबरीने हलत नाही; अनुभव त्रासदायक असेल. अचूक संरेखन सुनिश्चित करून, ही स्क्रिप्ट AR ला नवीनतेतून एका टूलमध्ये बदलते जे आभासी मीटिंग किंवा प्रगत गेमिंग सारख्या अनुप्रयोगांना समर्थन देऊ शकते.

दुसरी स्क्रिप्ट शेडर प्रोग्रामिंगमध्ये शोधते, विशेषत: लेन्सच्या विकृतीला संबोधित करते. शेडर _DistortionStrength सारख्या गुणधर्मांचा वापर करून, UV निर्देशांक टेक्सचरवर कसे मॅप केले जातात हे हाताळण्यासाठी कॅमेरा फीडमधील विकृती सुधारतो. वाइड-एंगल लेन्स किंवा अनन्य विरूपण प्रोफाइल असलेल्या कॅमेऱ्यांशी व्यवहार करताना हे विशेषतः उपयुक्त आहे. उदाहरणार्थ, कोनाच्या आधारावर व्हर्च्युअल हेड वास्तविक चेहऱ्यापेक्षा मोठे किंवा लहान दिसल्यास, विरूपण सेटिंग्ज ट्वीक केल्याने चांगले संरेखन सुनिश्चित होते. हे फनहाऊस इफेक्ट काढून टाकण्यासाठी आरशाची फ्रेम समायोजित करण्यासारखे आहे, प्रतिबिंब अधिक वास्तववादी बनवते. 🎨

शेवटी, तिसऱ्या स्क्रिप्टमधील युनिट चाचण्या उपायांचे प्रमाणीकरण करतात. या चाचण्या व्हर्च्युअल हेडची अपेक्षित स्थिती आणि रोटेशनची वास्तविक परिणामांशी तुलना करतात, विविध परिस्थितींमध्ये समायोजने टिकून राहतील याची खात्री करून. NUnit वापरणे ठामपणे.AreEqual, संरेखनाची पुष्टी करण्यासाठी, विकासक वेगवेगळ्या परिस्थितींचे अनुकरण करू शकतात, जसे की डोके वेगाने हलवणे किंवा ते अत्यंत कोनात वाकवणे. उदाहरणार्थ, विकासादरम्यान, माझ्या लक्षात आले की समोरासमोर उभे असताना संरेखन चांगले कार्य करते परंतु जेव्हा डोके बाजूला वळते तेव्हा ते वाहून जाते. या युनिट चाचण्यांनी समस्येवर प्रकाश टाकला आणि पुढील सुधारणांचे मार्गदर्शन केले, मजबूत AR अनुप्रयोग तयार करण्यासाठी कसून चाचणीचे महत्त्व अधिक बळकट केले. 🚀

युनिटी आणि मीडियापाइपसह AR मध्ये व्हर्च्युअल ऑब्जेक्ट प्लेसमेंट समायोजित करणे

उपाय 1: FOV आणि लेन्स विकृती समायोजित करण्यासाठी युनिटीचा भौतिक कॅमेरा वापरणे

// Import necessary Unity librariesusing UnityEngine;using Mediapipe.Unity;public class VirtualHeadAdjuster : MonoBehaviour{public Camera mainCamera; // Assign Unity's physical camerapublic GameObject virtualHead; // Assign the virtual head prefabprivate MediapipeFaceMesh faceMesh; // MediaPipe's face mesh componentvoid Start(){// Enable Unity's physical cameramainCamera.usePhysicalProperties = true;mainCamera.focalLength = 35f; // Set a standard focal length}void Update(){if (faceMesh != null && faceMesh.IsTracking){// Update the virtual head's position and rotationTransform detectedHead = faceMesh.GetDetectedFaceTransform();virtualHead.transform.position = detectedHead.position;virtualHead.transform.rotation = detectedHead.rotation;}}}

व्हर्च्युअल हेड अलाइनमेंटसाठी पर्यायी ऍडजस्टमेंट एक्सप्लोर करत आहे

उपाय २: लेन्स विकृती दुरुस्त करण्यासाठी सानुकूल शेडर वापरणे

१युनिटीच्या एआर प्रोजेक्ट्समध्ये वर्धित सुसंगततेसाठी चाचणी

उपाय 3: वर्च्युअल हेड अलाइनमेंटसाठी युनिट चाचण्यांची अंमलबजावणी करणे

using NUnit.Framework;using UnityEngine;using Mediapipe.Unity;[TestFixture]public class VirtualHeadAlignmentTests{private VirtualHeadAdjuster adjuster;private GameObject testHead;[SetUp]public void Init(){GameObject cameraObject = new GameObject("MainCamera");adjuster = cameraObject.AddComponent<VirtualHeadAdjuster>();testHead = new GameObject("VirtualHead");adjuster.virtualHead = testHead;}[Test]public void TestVirtualHeadAlignment(){Vector3 expectedPosition = new Vector3(0, 1, 2);Quaternion expectedRotation = Quaternion.Euler(0, 45, 0);adjuster.virtualHead.transform.position = expectedPosition;adjuster.virtualHead.transform.rotation = expectedRotation;Assert.AreEqual(expectedPosition, testHead.transform.position);Assert.AreEqual(expectedRotation, testHead.transform.rotation);}}

वर्धित कॅलिब्रेशन तंत्राद्वारे एआर प्लेसमेंट परिष्कृत करणे

AR संरेखन समस्यांमधला एक दुर्लक्षित पैलू म्हणजे कॅमेरा कॅलिब्रेशनचे महत्त्व. एआर प्रोजेक्ट्समध्ये वास्तविक डोके वर आभासी डोके ठेवणे, लेन्सचे अंतर्गत पॅरामीटर्स महत्वाची भूमिका बजावतात. या पॅरामीटर्समध्ये फोकल लांबी, ऑप्टिकल सेंटर आणि विकृती गुणांक यांचा समावेश होतो. जेव्हा ही मूल्ये अचूक नसतात, तेव्हा आभासी हेड चुकीचे किंवा विकृत दिसू शकते. हे संबोधित करण्यासाठी, विशिष्ट डिव्हाइस कॅमेऱ्यासाठी या पॅरामीटर्सची गणना करण्यासाठी कॅलिब्रेशन साधने वापरली जाऊ शकतात. उदाहरणार्थ, OpenCV सारखे सॉफ्टवेअर अचूक कॅमेरा मॅट्रिक्स आणि विरूपण प्रोफाइल तयार करण्यासाठी मजबूत कॅलिब्रेशन उपयुक्तता प्रदान करते. 📐

दुसऱ्या पध्दतीमध्ये युनिटीचा फायदा घेणे समाविष्ट आहे पोस्ट-प्रोसेसिंग स्टॅक. डेप्थ ऑफ फील्ड किंवा क्रोमॅटिक ॲबरेशन दुरुस्त्यांसारखे प्रभाव लागू करून, तुम्ही रेंडर केलेले व्हर्च्युअल हेड आणि वास्तविक-जागतिक वातावरण यांच्यातील विसंगती दूर करू शकता. पोस्ट-प्रोसेसिंग पॉलिशचा एक थर जोडते जे आभासी वस्तू आणि भौतिक स्थानांमधील अंतर कमी करते. उदाहरणार्थ, एक सूक्ष्म अस्पष्ट प्रभाव चुकीचे संरेखन लक्षात येण्याजोगा बनवणाऱ्या कठोर कडा कमी करू शकतो. हे विशेषतः इमर्सिव्ह ऍप्लिकेशन्समध्ये उपयुक्त आहे जेथे वापरकर्ते दृश्यावर जास्त लक्ष केंद्रित करतात.

शेवटी, रनटाइम दरम्यान डायनॅमिक अनुकूलन शक्तीला कमी लेखू नका. तुमच्या AR पाइपलाइनमध्ये मशीन लर्निंग मॉडेल्सचा समावेश केल्याने सिस्टमला वेळोवेळी प्लेसमेंट शिकण्याची आणि समायोजित करण्याची अनुमती मिळते. उदाहरणार्थ, एआय मॉडेल वापरकर्त्याच्या फीडबॅकचे विश्लेषण करू शकते किंवा विसंगती शोधू शकते आणि डायनॅमिक पद्धतीने संरेखन ठीक करू शकते. हे सिस्टमला अधिक मजबूत आणि प्रकाश, डिव्हाइस कार्यप्रदर्शन किंवा वापरकर्त्याच्या वर्तनातील फरकांना सामोरे जाण्यास सक्षम बनवते. या सुधारणा अखंड AR अनुभवाची खात्री देतात, ज्यामुळे व्हर्च्युअल आणि वास्तविक जग खऱ्या अर्थाने एकत्रित होतात. 🚀

MediaPipe आणि Unity AR प्लेसमेंटबद्दल सामान्य प्रश्न

- माझे आभासी डोके खऱ्या चेहऱ्याशी का चुकीचे आहे?

- समस्या अनेकदा अयोग्य कॅमेरा कॅलिब्रेशनमुळे उद्भवते. ची गणना करण्यासाठी OpenCV सारखी साधने वापरणे camera matrix आणि १ संरेखन मोठ्या प्रमाणात सुधारू शकते.

- एआर संरेखनामध्ये फोकल लांबीची भूमिका काय आहे?

- द focal length कॅमेरा 2D प्लेनवर 3D पॉइंट कसे प्रोजेक्ट करतो ते परिभाषित करते. युनिटीच्या भौतिक कॅमेरा सेटिंग्जमध्ये ते समायोजित केल्याने अचूकता वाढू शकते.

- युनिटी लेन्स विकृती सुधारणे हाताळू शकते?

- होय, युनिटी विकृती सुधारण्यासाठी शेडर्सचे समर्थन करते. सारख्या गुणधर्मांसह शेडर लागू करा _DistortionStrength तुमच्या लेन्स प्रोफाइलवर आधारित सुधारणा सानुकूलित करण्यासाठी.

- मी आभासी वस्तूंचे संरेखन कसे तपासू शकतो?

- सारख्या आदेशांसह NUnit मध्ये युनिट चाचण्या वापरणे Assert.AreEqual तुम्हाला विविध परिस्थितींमध्ये व्हर्च्युअल ऑब्जेक्ट्सचे पोझिशनिंग आणि रोटेशन प्रमाणित करण्याची परवानगी देते.

- एआर प्रकल्पांसाठी पोस्ट-प्रोसेसिंग आवश्यक आहे का?

- अनिवार्य नसताना, पोस्ट-प्रोसेसिंग प्रभाव जसे ५ आणि chromatic aberration AR दृश्यांची व्हिज्युअल गुणवत्ता आणि वास्तववाद वाढवू शकतो.

- MediaPipe चेहऱ्यांव्यतिरिक्त इतर वस्तू शोधू शकतात?

- होय, MediaPipe हात, पोझ आणि अगदी समग्र ट्रॅकिंगसाठी उपाय ऑफर करते, ज्यामुळे ते विविध AR वापर प्रकरणांसाठी बहुमुखी बनते.

- युनिटी एआर ऍप्लिकेशन्ससाठी कोणते हार्डवेअर सर्वोत्तम कार्य करते?

- उच्च-कार्यक्षमता असलेले GPU आणि अचूक कॅमेरे असलेली उपकरणे आदर्श आहेत. सारखी साधने ७ आणि ARKit अधिक सुसंगतता वाढवा.

- विशिष्ट कोनांवर संरेखन का वाईट आहे?

- हे कॅमेरा आणि व्हर्च्युअल वातावरणामधील दृश्याच्या क्षेत्रामध्ये जुळत नसल्यामुळे असू शकते. युनिटी कॅमेरा समायोजित करत आहे ९ मालमत्ता मदत करू शकते.

- शेडर्स एआर संरेखन कसे सुधारतात?

- शेडर्स रेंडरिंगमध्ये रिअल-टाइम ऍडजस्टमेंटसाठी परवानगी देतात, जसे की विकृती दुरुस्त करणे किंवा लेन्स इफेक्ट्सचे अनुकरण करणे, आभासी आणि वास्तविक वस्तूंमध्ये चांगले सिंक्रोनाइझेशन सुनिश्चित करणे.

- एआर सिस्टम वेळेनुसार स्वत: समायोजित करू शकतात?

- होय, मशिन लर्निंग मॉडेल्स एकत्रित केल्याने सिस्टीमला गतीशीलपणे जुळवून घेण्यास सक्षम करते, फीडबॅकमधून शिकून वेळोवेळी संरेखन आणि कार्यप्रदर्शन सुधारते.

AR अचूकता वाढवणे: अंतिम विचार

इमर्सिव्ह AR अनुभवांसाठी व्हर्च्युअल आणि रिअल-वर्ल्ड ऑब्जेक्ट्समधील अचूक संरेखन साध्य करणे महत्त्वाचे आहे. काळजीपूर्वक कॅलिब्रेशन आणि प्रगत तंत्रांद्वारे, लेन्सची विकृती आणि न जुळणारी फोकल लांबी यांसारख्या समस्या कमी केल्या जाऊ शकतात, उत्तम अचूकता आणि वापरकर्त्याचे समाधान सुनिश्चित करणे.

युनिटी टूल्स, मीडियापाइप अल्गोरिदम आणि डायनॅमिक ऍडजस्टमेंट एकत्रित करणे एआर डेव्हलपर्ससाठी मजबूत उपाय ऑफर करते. या सुधारणांमुळे गेमिंग, व्हर्च्युअल मीटिंग आणि त्याही पलीकडे नवीन शक्यता अनलॉक करून डिजिटल आणि भौतिक जगाचे अखंड मिश्रण सक्षम होते. चिकाटी आणि नावीन्यपूर्णतेसह, AR संरेखन आव्हाने आटोपशीर बनतात. 🚀

स्रोत आणि संदर्भ

- युनिटीमध्ये MediaPipe वापरण्याविषयीचे तपशील अधिकृत MediaPipe दस्तऐवजीकरणातून संदर्भित केले गेले. ते एक्सप्लोर करा येथे .

- युनिटीच्या कॅमेरा कॅलिब्रेशन आणि भौतिक गुणधर्मांबद्दल मार्गदर्शन युनिटी दस्तऐवजीकरण साइटवर आढळू शकते. भेट द्या युनिटी कॅमेरा सेटिंग्ज अधिक तपशीलांसाठी.

- एआर ऍप्लिकेशन्स आणि लेन्स विकृती सुधारण्यासाठी शेडर प्रोग्रामिंग शेडर डेव्हलपमेंटवरील लेखांद्वारे प्रेरित होते, जसे की Catlike कोडिंग .

- Google च्या ARCore डेव्हलपर साइटवरून Android विकासासाठी ARCore क्षमता आणि मर्यादांचे पुनरावलोकन केले गेले. येथे अधिक जाणून घ्या Google ARCore .