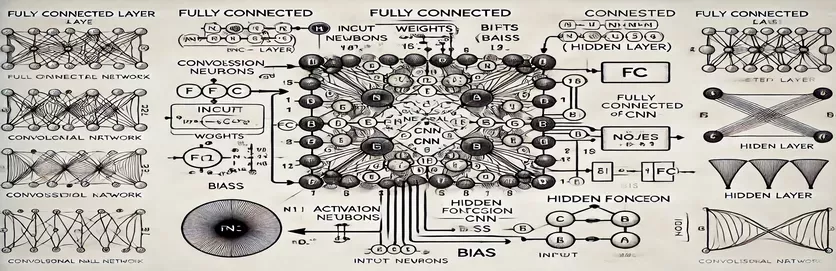

Демистификация полносвязных слоев в CNN

Понимание работы полностью подключенного слоя (FC) в сверточной нейронной сети (CNN) может показаться разгадкой тайны. Для многих сложность заключается в процессе вычислений и в том, как получается один узел скрытого слоя. В отличие от традиционных искусственных нейронных сетей (ИНС), уровень FC в CNN имеет нюансы, которые часто не объясняются в учебных пособиях. Если вы озадачены этим, вы не одиноки!

Многие ресурсы игнорируют эту тему, оставляя учащихся без четких указаний. В учебниках часто повторяются неполные объяснения, что усиливает разочарование тех, кто ищет ясности. Если вы неоднократно искали ответы, вы попали по адресу. 🧩

В этом руководстве мы сосредоточимся на вычислении одного узла из скрытого слоя слоя FC. Как только вы поймете механизм работы одного узла, вы будете готовы справиться со всем остальным. Разбив этот процесс на четкие и практические шаги, вы обретете уверенность в выполнении любых расчетов слоев FC.

Используя подходящие примеры и простую диаграмму, мы проиллюстрируем путь от входов к выходам на уровне FC. Попрощайтесь с путаницей и здравствуйте с пониманием — давайте углубимся! 🚀

| Команда | Пример использования |

|---|---|

| np.dot() | Выполняет скалярное произведение между двумя массивами. Используется здесь для расчета взвешенной суммы входных данных и весов узла в полностью связном слое. |

| np.maximum() | Применяет функцию активации ReLU, выбирая максимальное значение между расчетным выходным значением и нулем. |

| torch.tensor() | Создает тензор в PyTorch. Тензоры — это основные строительные блоки для представления данных в средах глубокого обучения. |

| torch.matmul() | Выполняет умножение матриц в PyTorch. Используется для вычисления скалярного произведения между входными данными и весами. |

| torch.nn.functional.relu() | Применяет функцию активации ReLU в PyTorch, устанавливая все отрицательные значения в тензоре на ноль. |

| np.testing.assert_array_almost_equal() | Сравнивает два массива поэлементно на предмет равенства в пределах определенного допуска. Полезно для проверки правильности вывода в числовых операциях. |

| unittest.TestCase | Базовый класс в модуле unittest для создания тестовых случаев. Используется для структурирования и организации модульных тестов в Python. |

| np.array() | Создает массив в NumPy. Массивы используются для представления входных данных, весов и смещений в вычислениях полносвязного слоя. |

| torch.matmul() | Функция PyTorch для умножения матриц, необходимая для расчета выходных данных в нейронных сетях. |

| unittest.main() | Запускает все тестовые случаи, определенные в сценарии. Необходим для проверки точности и надежности реализованных решений. |

Разбивка вычислений полносвязных слоев

Предоставленные сценарии призваны прояснить, как узел в Уровень CNN обрабатывает данные из предыдущего уровня. Эти слои соединяют каждый вход с каждым узлом, используя взвешенные связи и смещения, что делает их незаменимыми для таких задач, как классификация изображений. Первый скрипт вычисляет выходные данные для одного узла, используя . Путем умножения входных значений на соответствующие им веса и добавления смещения получается выход узла. Затем этот выходной сигнал передается через функцию активации (например, ReLU) для введения нелинейности. Например, представьте себе значения пикселей изображения в качестве входных данных; веса могут представлять собой изученные фильтры, которые извлекают значимые функции из изображения. 🖼️

Второй скрипт обобщает расчет для нескольких узлов. Он использует умножение матриц, где веса представлены в виде двумерной матрицы, а входные данные — в виде вектора. Этот эффективный подход позволяет выполнять одновременные вычисления для всех узлов слоя. Путем добавления смещений и применения функции активации ReLU создаются окончательные результаты слоя. Этот метод хорошо масштабируем и является основной операцией в современных средах глубокого обучения. Например, в системе распознавания лиц этот процесс может помочь определить, похожа ли обнаруженная форма на человеческое лицо. 😊

Для тех, кто работает с библиотеками глубокого обучения, такими как , третий скрипт демонстрирует, как использовать тензоры и встроенные функции для достижения тех же вычислений. Гибкость PyTorch и встроенные возможности оптимизации делают его идеальным для создания и обучения нейронных сетей. Сценарий показывает, как определить входные данные, веса и смещения в виде тензоров и выполнить умножение матриц с помощью функция. Это особенно полезно для создания сквозных конвейеров для обучения CNN на больших наборах данных, например, для идентификации животных на фотографиях дикой природы.

Наконец, сценарий модульных тестов гарантирует правильную работу всех реализаций в различных условиях. Используя библиотеки, он проверяет численную точность вычислений и подтверждает, что выходные данные соответствуют ожидаемым результатам. Этот шаг имеет решающее значение для отладки и обеспечения надежности, особенно при развертывании CNN в реальных приложениях, таких как анализ медицинских изображений. Благодаря этим сценариям и объяснениям у вас теперь есть четкий путь к пониманию и уверенному внедрению слоев FC в CNN. 🚀

Понимание расчета узла в полносвязном слое

Решение на основе Python, использующее NumPy для матричных вычислений

# Import necessary libraryimport numpy as np# Define inputs to the fully connected layer (e.g., from previous convolutional layers)inputs = np.array([0.5, 0.8, 0.2]) # Example inputs# Define weights for the first node in the hidden layerweights_node1 = np.array([0.4, 0.7, 0.3])# Define bias for the first nodebias_node1 = 0.1# Calculate the output for node 1node1_output = np.dot(inputs, weights_node1) + bias_node1# Apply an activation function (e.g., ReLU)node1_output = max(0, node1_output)# Print the resultprint(f"Output of Node 1: {node1_output}")

Обобщение расчета узлов в полностью связанных слоях

Решение на основе Python для расчета всех узлов скрытого слоя

# Import necessary libraryimport numpy as np# Define inputs to the fully connected layerinputs = np.array([0.5, 0.8, 0.2])# Define weights matrix (rows: nodes, columns: inputs)weights = np.array([[0.4, 0.7, 0.3], # Node 1[0.2, 0.9, 0.5]]) # Node 2# Define bias for each nodebiases = np.array([0.1, 0.2])# Calculate outputs for all nodesoutputs = np.dot(weights, inputs) + biases# Apply activation function (e.g., ReLU)outputs = np.maximum(0, outputs)# Print the resultsprint(f"Outputs of Hidden Layer: {outputs}")

Использование PyTorch для расчета узлов на полностью связном слое

Реализация с помощью PyTorch для энтузиастов глубокого обучения

# Import PyTorchimport torch# Define inputs as a tensorinputs = torch.tensor([0.5, 0.8, 0.2])# Define weights and biasesweights = torch.tensor([[0.4, 0.7, 0.3], # Node 1[0.2, 0.9, 0.5]]) # Node 2biases = torch.tensor([0.1, 0.2])# Calculate outputsoutputs = torch.matmul(weights, inputs) + biases# Apply ReLU activationoutputs = torch.nn.functional.relu(outputs)# Print resultsprint(f"Outputs of Hidden Layer: {outputs}")

Протестируйте каждое решение с помощью модульных тестов

Модульные тесты на основе Python для обеспечения правильности реализаций.

# Import unittest libraryimport unittest# Define the test case classclass TestNodeCalculation(unittest.TestCase):def test_single_node(self):inputs = np.array([0.5, 0.8, 0.2])weights_node1 = np.array([0.4, 0.7, 0.3])bias_node1 = 0.1expected_output = max(0, np.dot(inputs, weights_node1) + bias_node1)self.assertEqual(expected_output, 0.86)def test_multiple_nodes(self):inputs = np.array([0.5, 0.8, 0.2])weights = np.array([[0.4, 0.7, 0.3],[0.2, 0.9, 0.5]])biases = np.array([0.1, 0.2])expected_outputs = np.maximum(0, np.dot(weights, inputs) + biases)np.testing.assert_array_almost_equal(expected_outputs, np.array([0.86, 0.98]))# Run the testsif __name__ == "__main__":unittest.main()

Раскрытие важности полностью связанных слоев в CNN

Полносвязные слои (FC) играют ключевую роль в преобразовании извлеченных признаков из сверточных слоев в окончательные прогнозы. Они работают, соединяя каждый вход с каждым выходом, обеспечивая плотное отображение изученных функций. В отличие от сверточных слоев, которые фокусируются на пространственных иерархиях, слои FC объединяют эту информацию для принятия решений, таких как идентификация объектов на изображении. Например, в системе распознавания изображений беспилотного автомобиля уровень FC может определять, является ли обнаруженный объект пешеходом или дорожным знаком. 🚗

Одним из аспектов, который отличает слои FC, является их способность обобщать закономерности, полученные во время обучения. Это свойство имеет решающее значение при работе с невидимыми данными. Каждый узел слоя представляет собой уникальную комбинацию весов и смещений, что позволяет ему специализироваться на распознавании определенных шаблонов или классов. Вот почему структура слоев FC часто определяет общую точность модели. Например, в модели распознавания рукописных цифр слой FC объединяет шаблоны пикселей в числовые прогнозы (0–9). ✍️

Хотя слои FC требуют больших вычислительных затрат из-за плотных связей, они остаются жизненно важными для задач, требующих детальной классификации. Современные методы, такие как отсев, используются для оптимизации их производительности за счет предотвращения переобучения. Уменьшая количество активных узлов во время обучения, отсев гарантирует, что уровень FC изучает надежные функции, что делает его незаменимым в таких приложениях, как распознавание лиц и диагностика медицинских изображений.

- Какова основная функция полносвязного слоя в CNN?

- Уровень FC соединяет все входы с выходами, объединяя объекты для окончательных прогнозов. Это ключ к преобразованию карт объектов в практические результаты.

- Как инициализируются веса и смещения в слоях FC?

- Веса часто инициализируются случайным образом или с использованием таких методов, как инициализация Ксавье, тогда как смещения обычно начинаются с нуля для простоты.

- Как активация ReLU улучшает производительность уровня FC?

- ReLU применяет нелинейность, устанавливая отрицательные выходные значения на ноль. Это предотвращает исчезновение градиентов, ускоряя сходимость модели.

- Можно ли применить дропаут к слоям FC?

- Да, отсев случайным образом отключает узлы во время обучения, улучшая обобщение модели и уменьшая переобучение.

- Что отличает слои FC от сверточных слоев?

- В то время как сверточные слои извлекают пространственные объекты, слои FC объединяют эти объекты в плотный формат для классификации.

Полностью связанный уровень объединяет изученные функции в действенные прогнозы, служащие окончательным этапом принятия решений в нейронных сетях. Понимая, как рассчитывается каждый узел, пользователи получают уверенность в проектировании и оптимизации архитектур CNN для таких задач, как обнаружение и классификация объектов.

Практические примеры, такие как распознавание изображений в автономных транспортных средствах или идентификация лиц, демонстрируют важность слоев FC. При правильном подходе включение методов оптимизации обеспечивает надежные и точные модели, которые хорошо адаптируются к невидимым данным. Овладение этой концепцией открывает возможность более глубокого изучения искусственного интеллекта. 😊

- Подробное объяснение полностью связанных слоев в CNN, полученное из Мастерство машинного обучения .

- Подробное руководство по функциям активации и их приложениям, полученное с сайта Аналитика Видья .

- Подробную информацию о методах отсева и оптимизации нейронных сетей можно найти на сайте Глубокий ИИ .

- Понимание весов и смещений в нейронных сетях из На пути к науке о данных .

- Использование функций активации ReLU в PyTorch, полученных из Документация PyTorch .